Durk Kingma, un científico de Inteligencia Artificial de Google twitteó algo que lo tenía pasmado:

“Los modelos generativos se están convirtiendo en una tecnología tan poderosa que parece magia, es una LOCURA. Y parece que la mayoría de las personas (que no son del mundo Machine Learning) todavía no conciben las implicancias. Esta tecnología va a transformar completamente la sociedad”.

¿Por qué Kingma, alguien acostumbrado a los mayores avances de la tecnología, justo ahora siente tanto entusiasmo con los resultados de los modelos generativos? ¿Qué lo desbordó hasta el punto de tener la necesidad de twittear que la mayoría de las personas están ciegas por no darse cuenta?

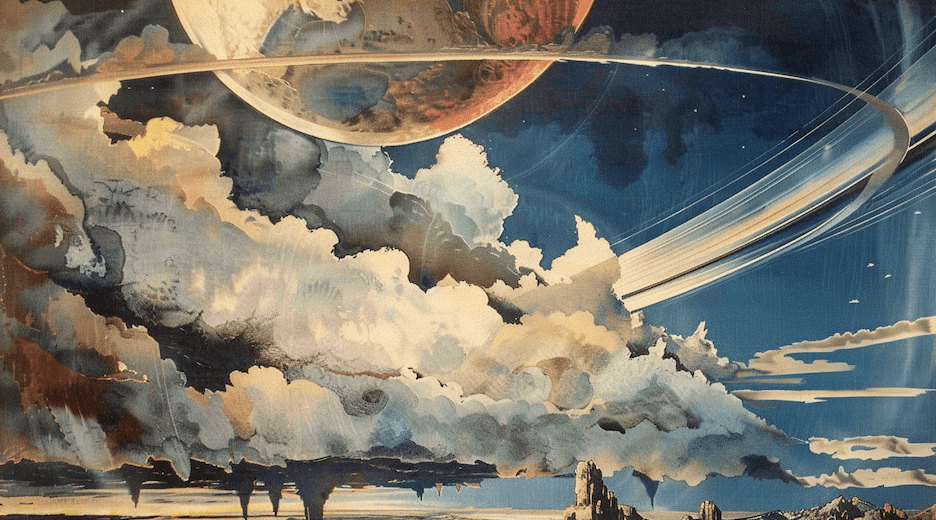

Es porque en abril del 2022, DALL-E (estilizado DALL·E) lanzó su versión mejorada que convierte cualquier texto en una imagen, pero no son representaciones sencillas. Parecen obras de arte.

La infancia de DALL-E

El DALL-E original podía representar imágenes solo de forma caricaturesca y poco realista, a menudo contra un fondo plano y con baja resolución.

Así que si por algún motivo uno le pedía “una ilustración de un rábano bebé en un tutú paseando a un perro”, curioso ejemplo que sale en la página de esta inteligencia artificial, este era el resultado.

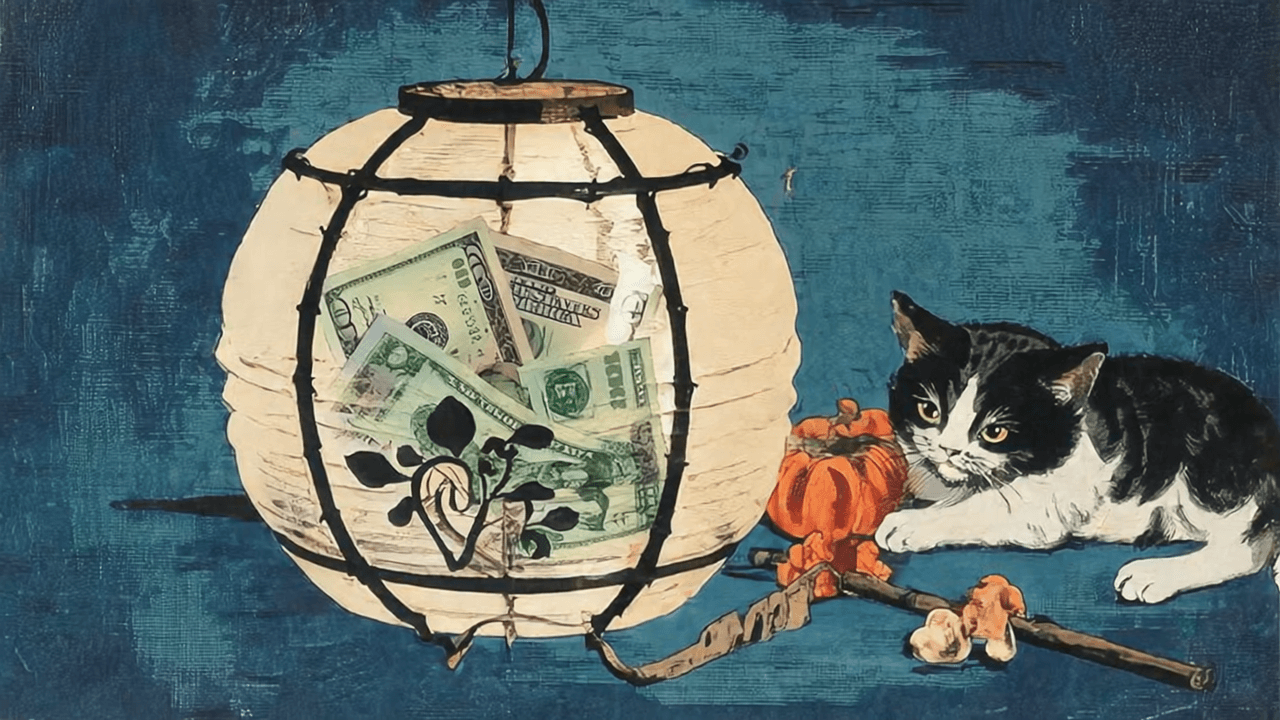

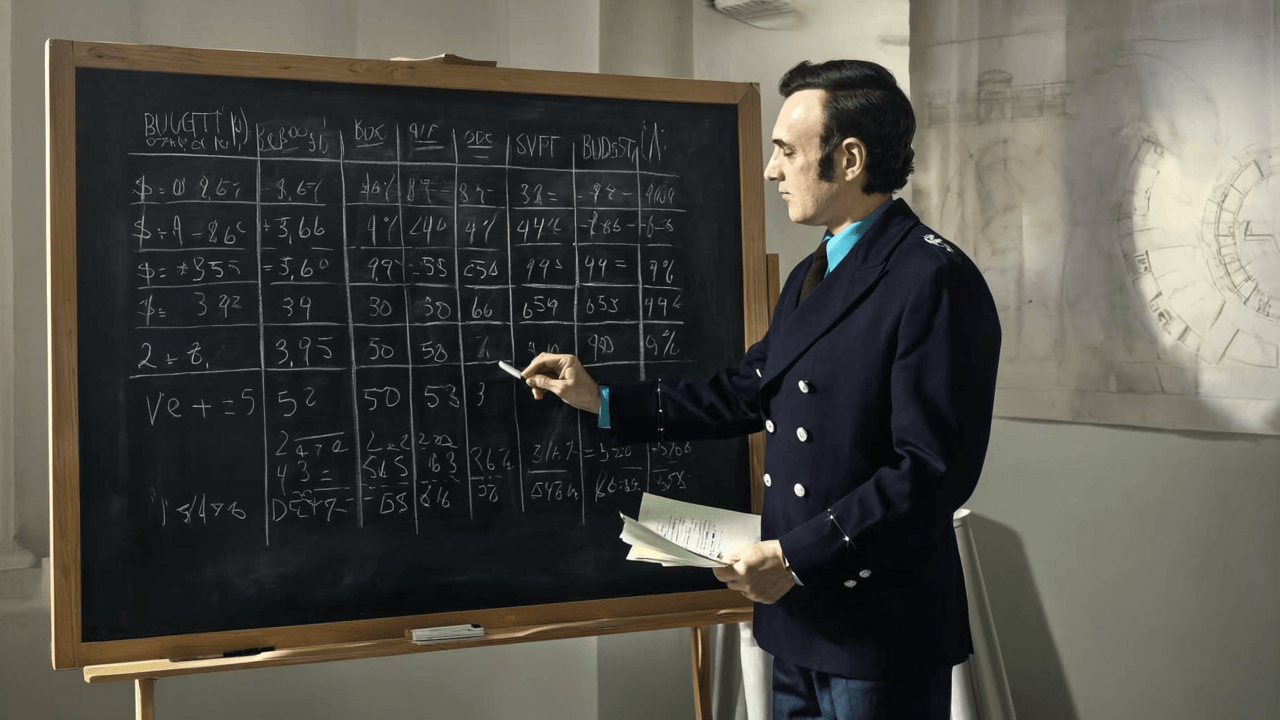

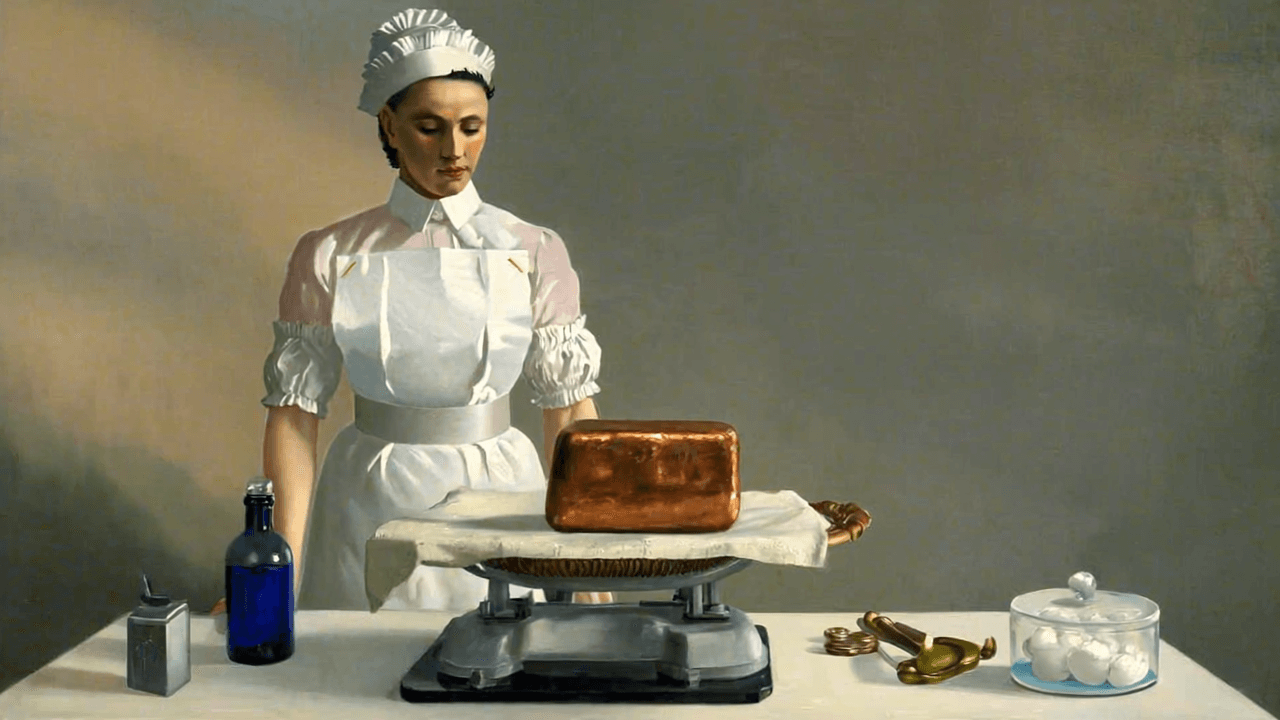

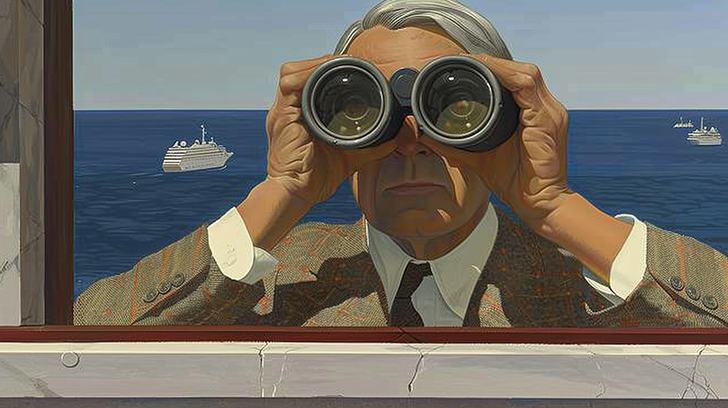

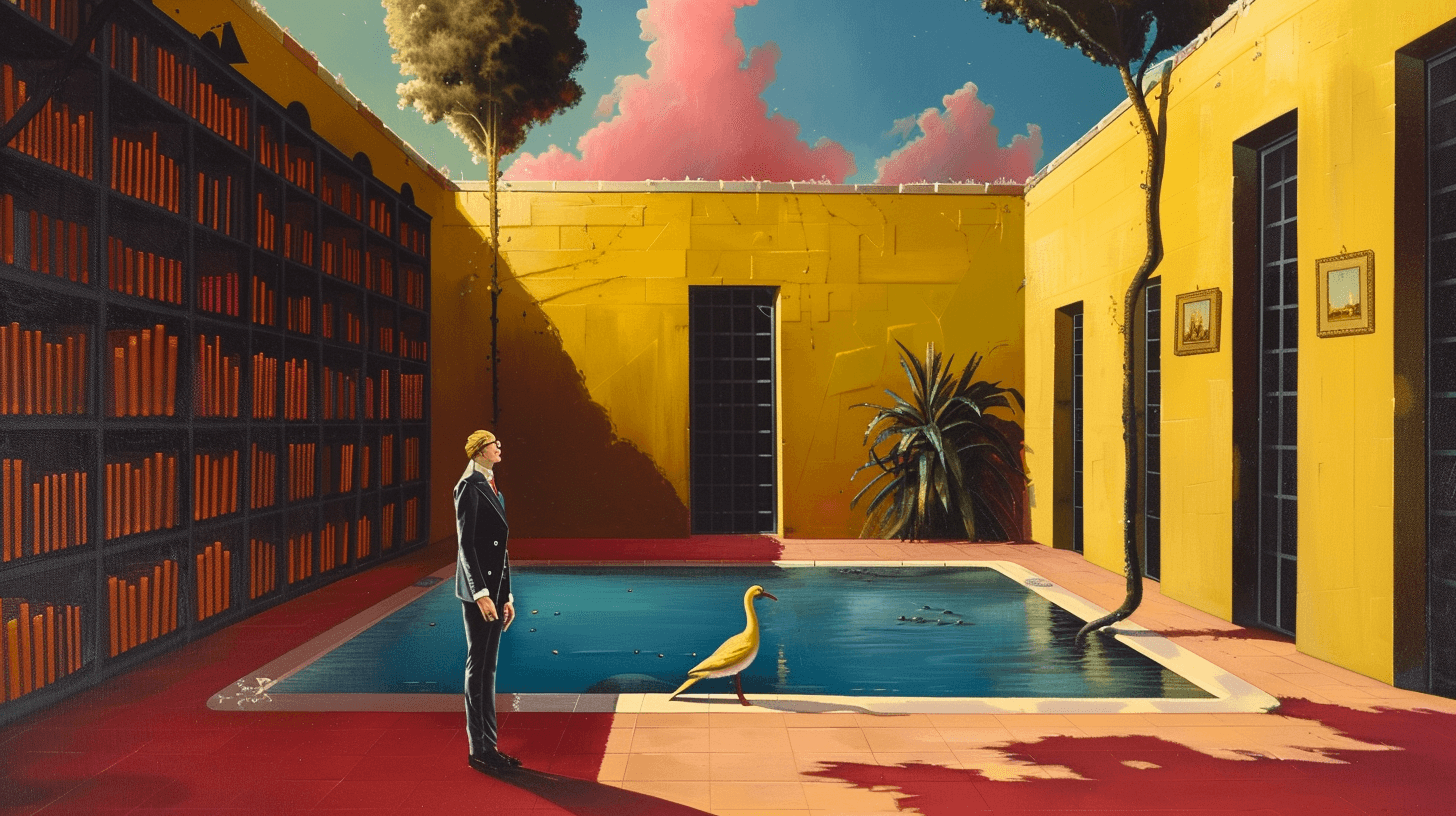

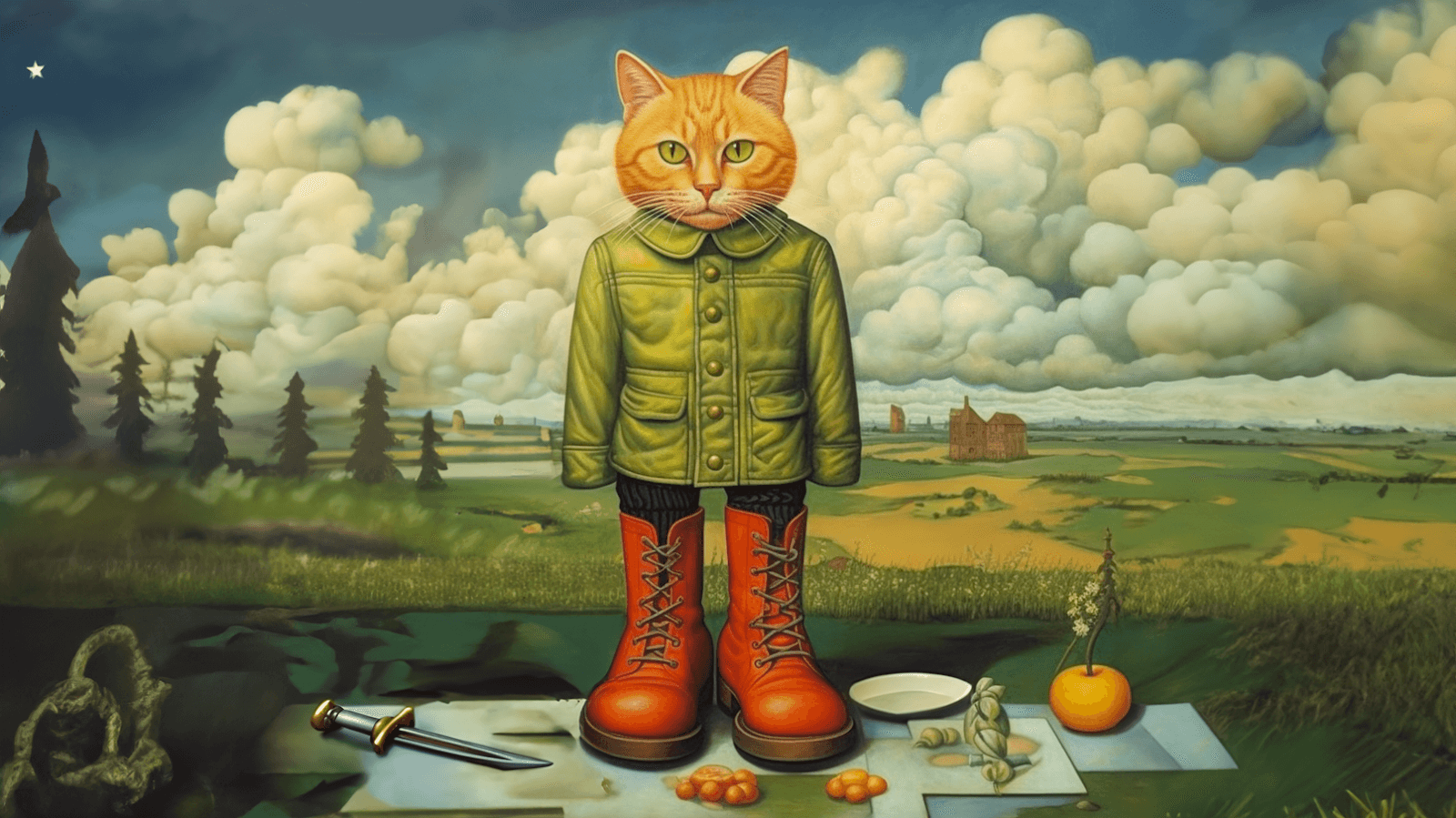

En cambio, impacta en el nuevo DALL-E 2 las imágenes de alta resolución con calidad fotográfica, con fondos complejos, efectos de profundidad de campo, sombras, sombreados y reflejos realistas.

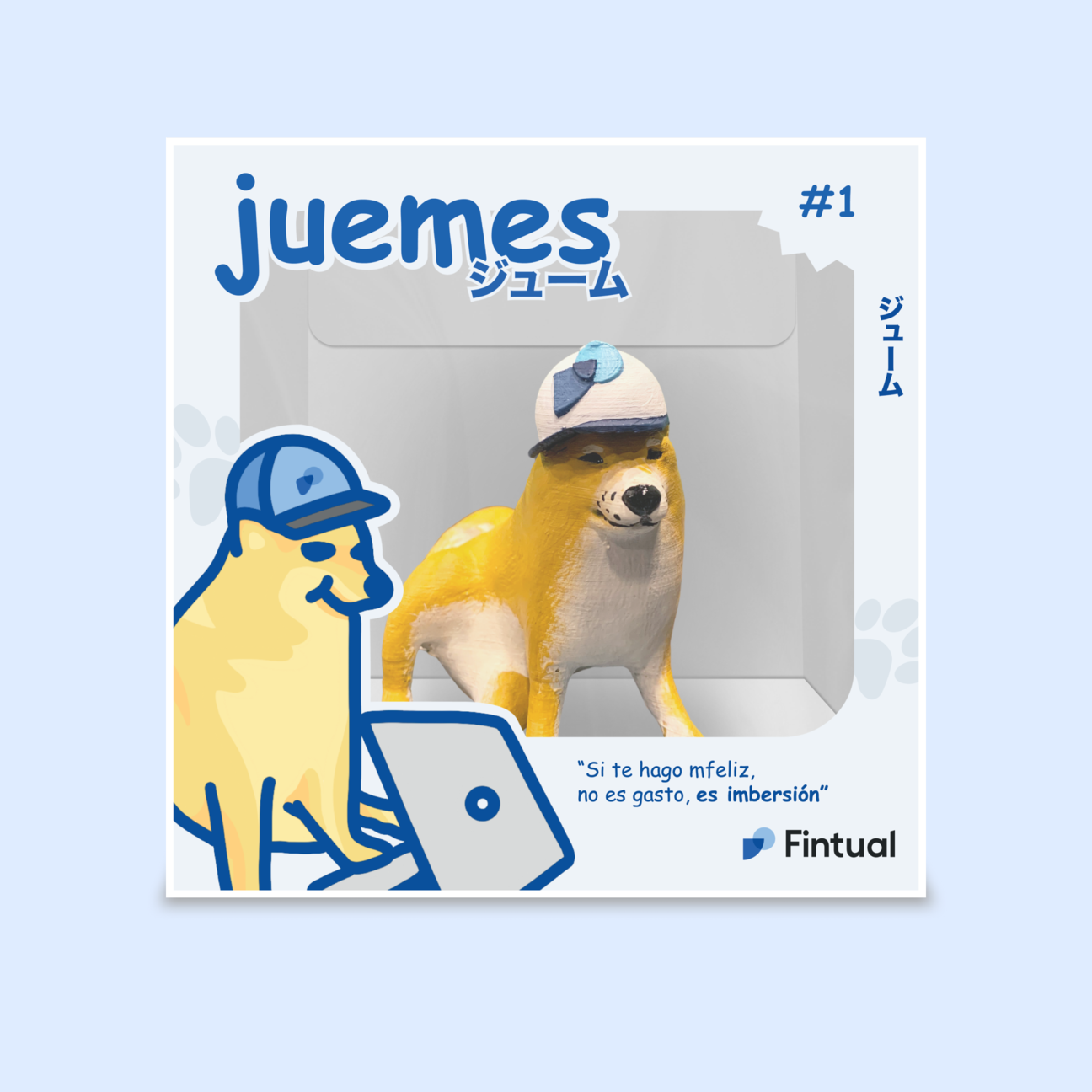

Uno le puede pedir “Un Shiba Inu con una boina negra y cuello tortuga” y Zás

También soporta descripciones más complejas como “Un conejo detective sentado en un banco del parque y leyendo un periódico en un ambiente victoriano”.

Al ver esto surgen muchas preguntas: la primera, si tenemos en cuenta la cercanía con el 1 de abril con el que fueron lanzadas estas imágenes. ¿Es verdad?

Sí, o mejor dicho, seguramente sí, ya que no hay nada que indique que sea mentira, aunque el marketing y hype en este lanzamiento es bien alto.

Como no hay mayores detalles del código, dataset o una publicación que permita replicar los resultados, uno puede preguntarse qué tan fácil sería conseguir resultados parecidos a los publicitados.

Para los más curiosos: ¿Cómo funciona Dall-E ?

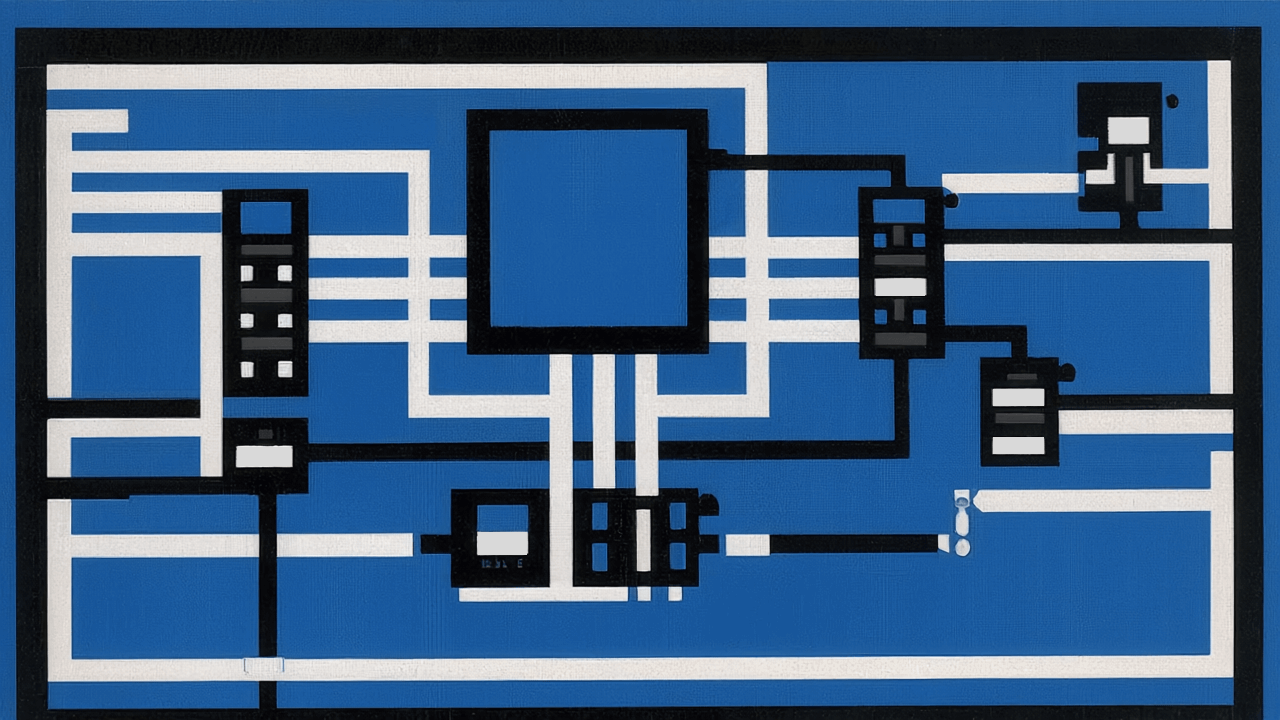

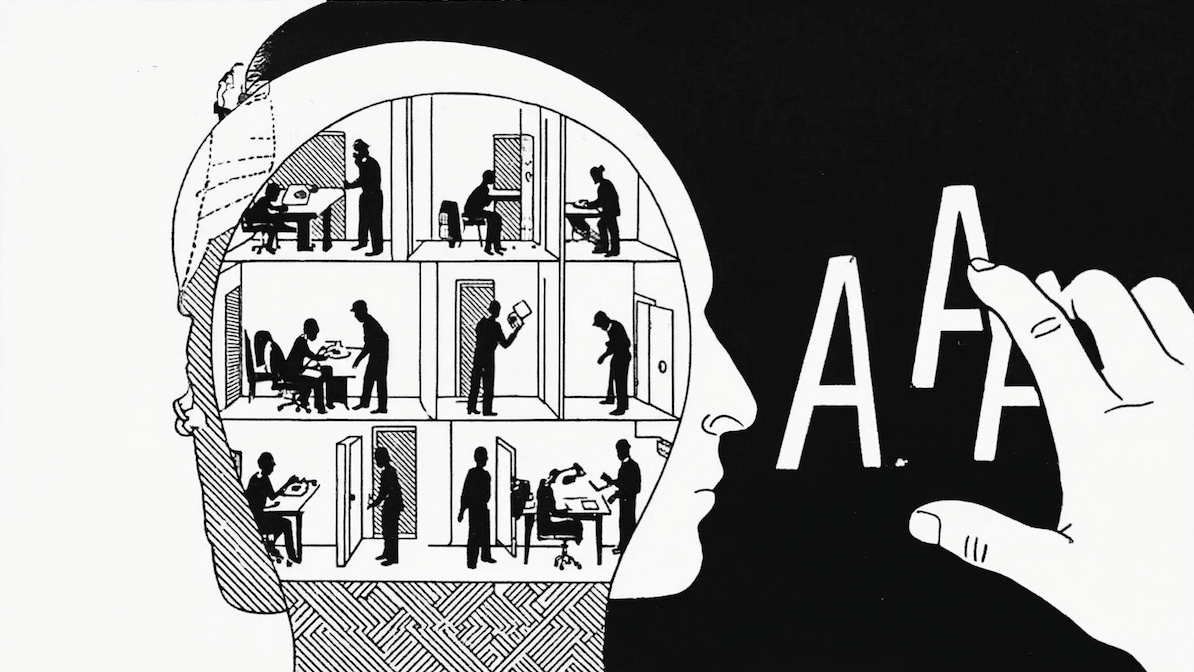

DALL·E tiene como uno de sus componentes principales una arquitectura de red neuronal nueva que es responsable de muchos de los avances recientes en ML: el Transformer.

Una red neuronal es una simulación de un cerebro, pero en una computadora. Es una forma en que una máquina puede procesar datos, que está inspirada en los cerebros humanos y animales.

A riesgo de molestar a verdaderos expertos del tema por lo incompleto e inexacto de la definición, un Transformer es un modelo de aprendizaje profundo (deep learning) que le da pesos diferentes a cada parte de los datos de entrada, y se entrena con datasets enormes. Es la misma tecnología que ha ayudado a mejorar la calidad de las búsquedas de Google, traducciones e incluso predecir la estructura de proteínas (te acuerdas de Alphafold 2?)

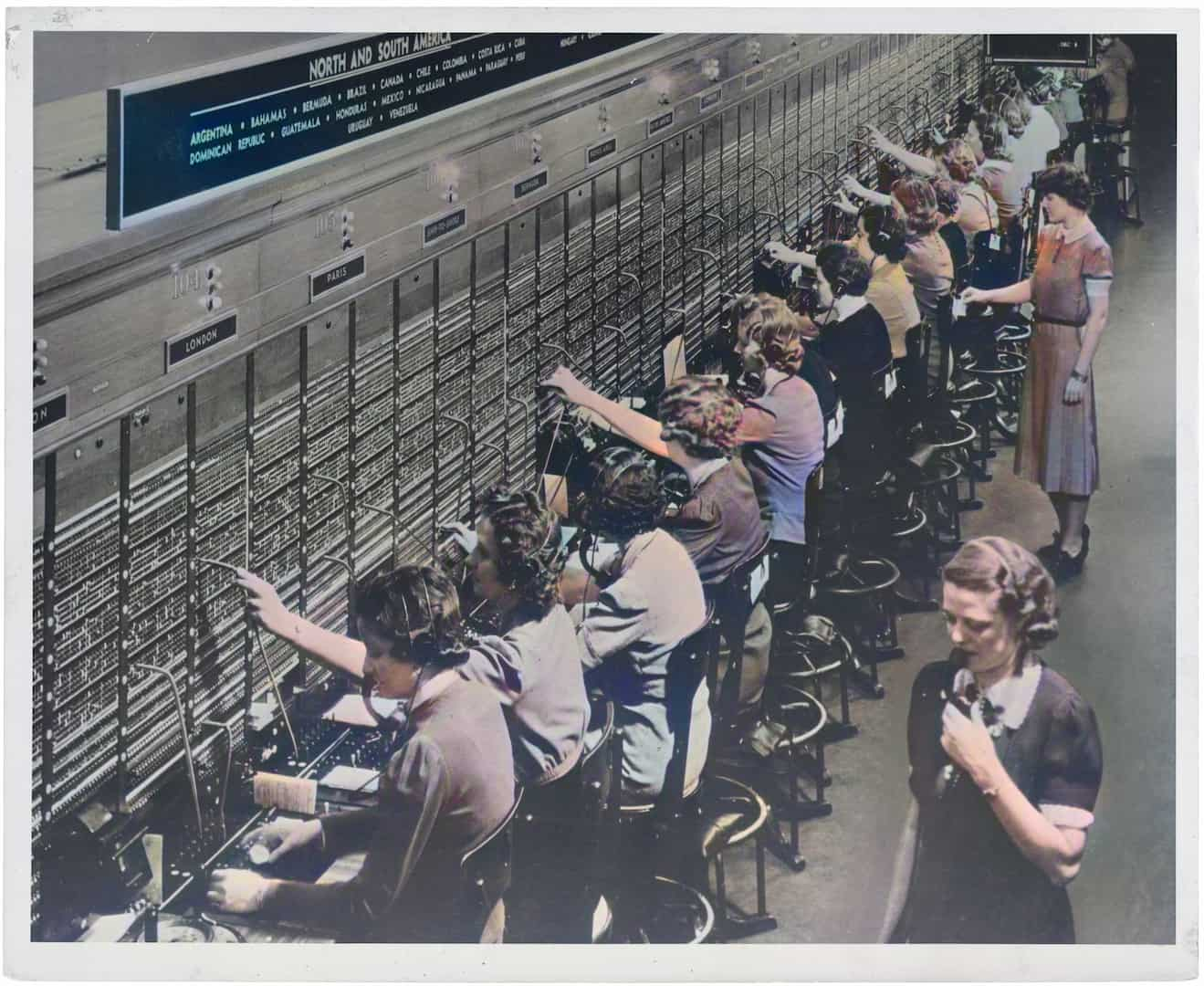

La mayoría de estos modelos de lenguaje están entrenados con conjuntos de datos de texto. Sin embargo, lo que hace que DALL·E se destaque es que se entrenó no solo con texto, sino que con pares de imágenes y frases. No sabemos exactamente qué conjunto de datos se usa para DALL-E, pero todo indica que es algo gigante .

Pero aunque estos resultados no dejan de impresionar, uno podría preguntarse si son tan buenos porque fueron copiados directamente del conjunto de datos. En otras palabras, quizás ya había por ahí una foto del perro Shiba Inucon, boina negra y cuello alto y el modelo solo lo encontró como una simple búsqueda de Google. Lo mismo se puede decir del conejo detective, después de todo no es tan difícil encontrar imágenes raras en internet:

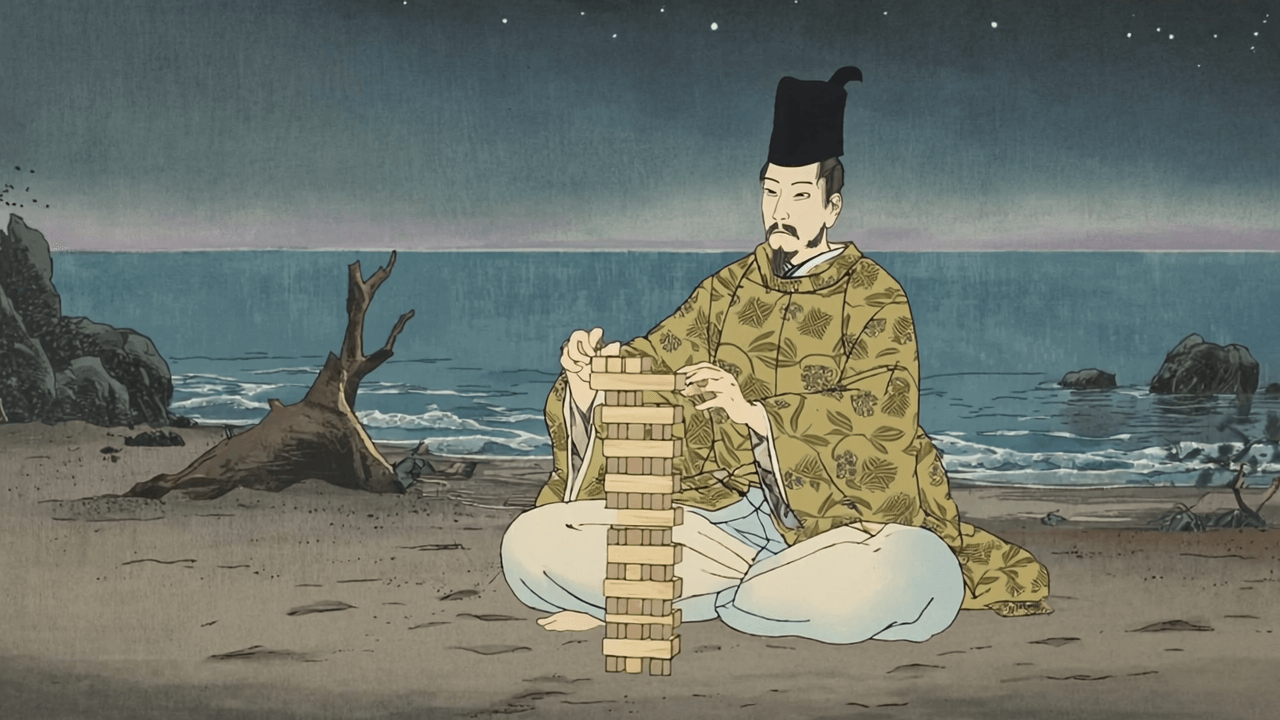

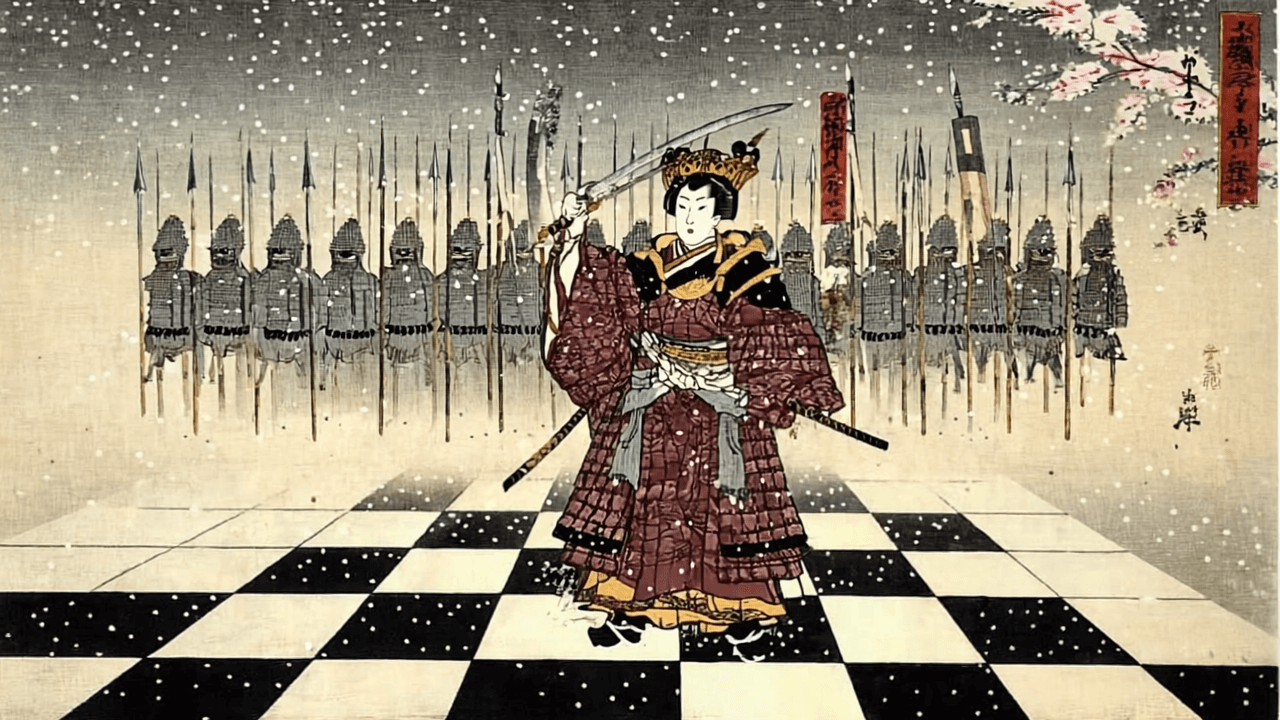

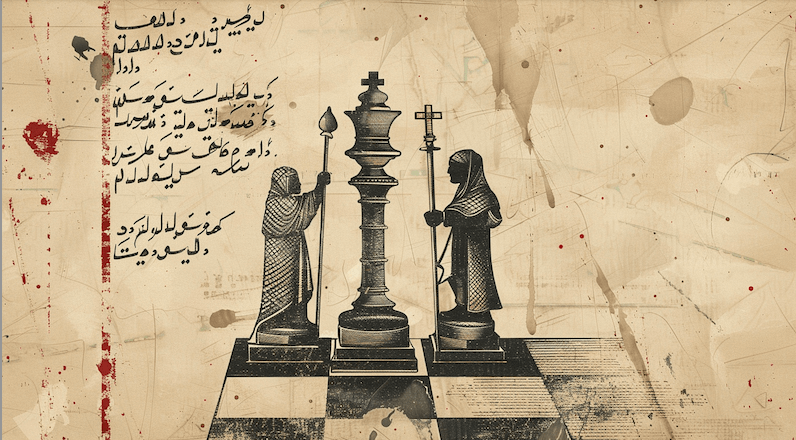

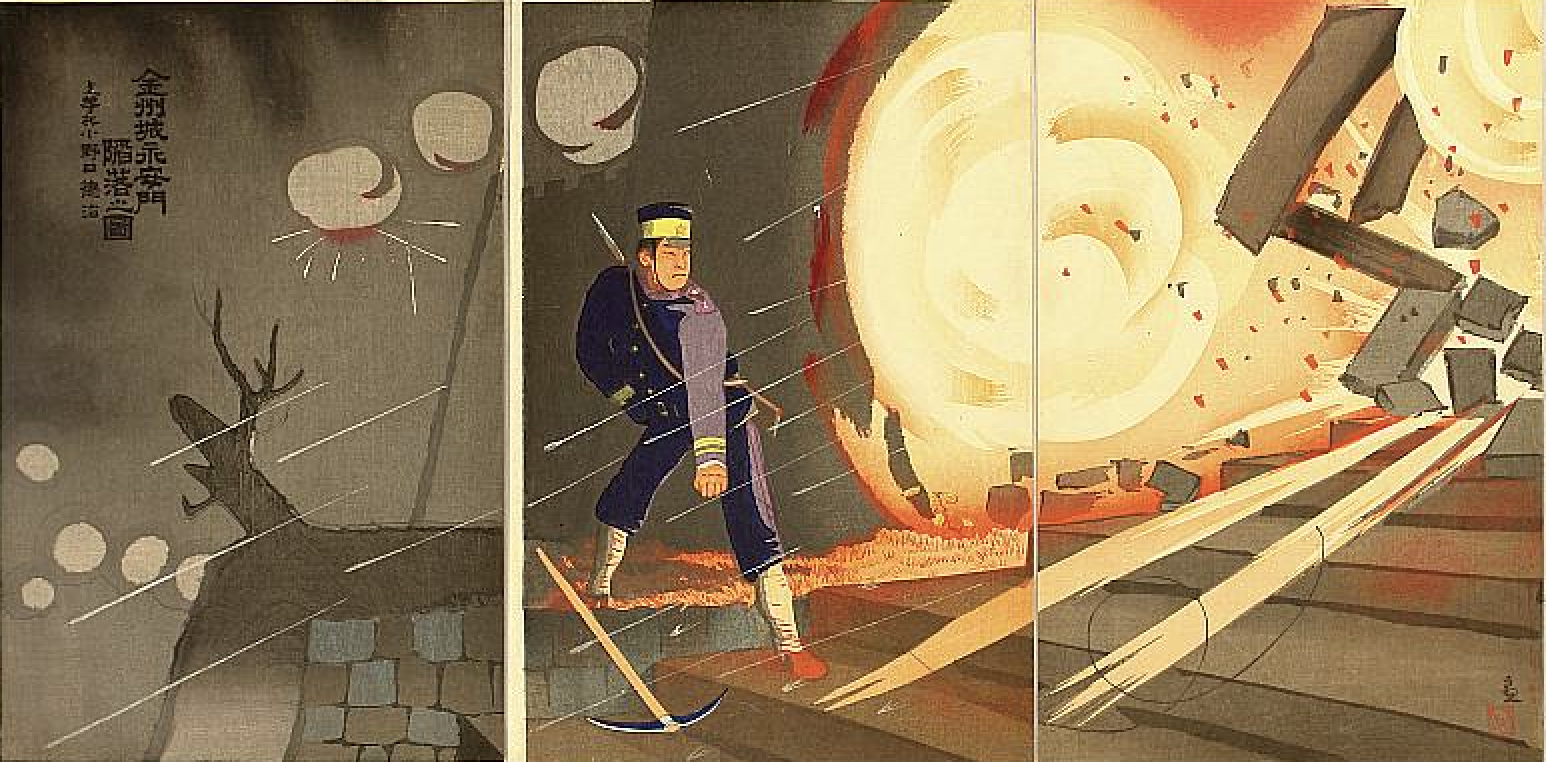

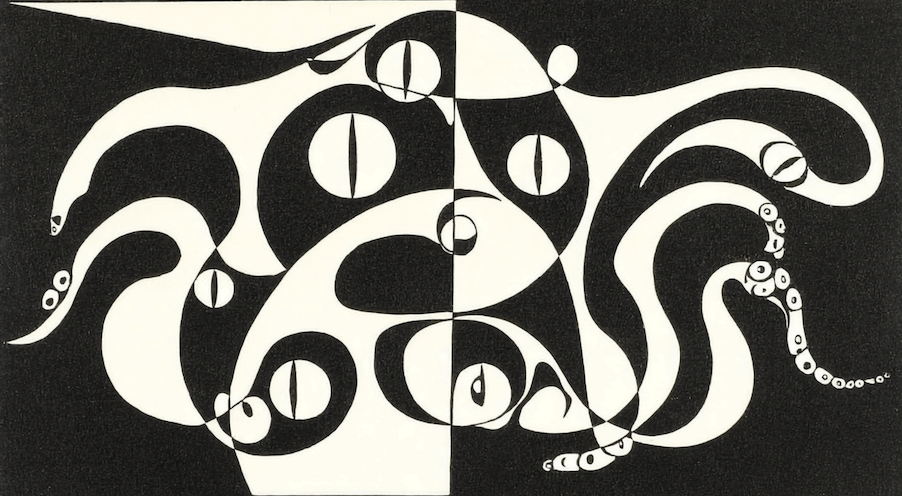

Para probar que DALL·E no solo está regurgitando imágenes, ya desde su primera versión los autores de OpenAI lo obligaron a mostrar algunas combinaciones bastante inusuales y específicas:

"una ilustración profesional de alta calidad de una quimera tortuga jirafa".

O “un caracol hecho de un arpa”

Sería muy raro que estas combinaciones ya existieran en los datos que se usaron para entrenar el modelo y así se comprueba que estamos en la presencia de algo auténtico

Es más, DALL-E puede generar imágenes que nunca ha visto antes (Zero-shot Visual Reasoning).

Disculpa por el spanglish, no conozco una traducción para estos términos que suene bien

Que es el Zero-Shot Visual Reasoning?

En Machine Learning, normalmente los modelos se entrenan dándole miles o millones de datos esperando que detecten un patrón.

Por ejemplo, para entrenar un modelo que identifique razas de perro, le mostramos a la red neuronal miles de fotos de perros etiquetadas con su raza y después probamos que tan bien puede etiquetar nuevas fotos de perros.

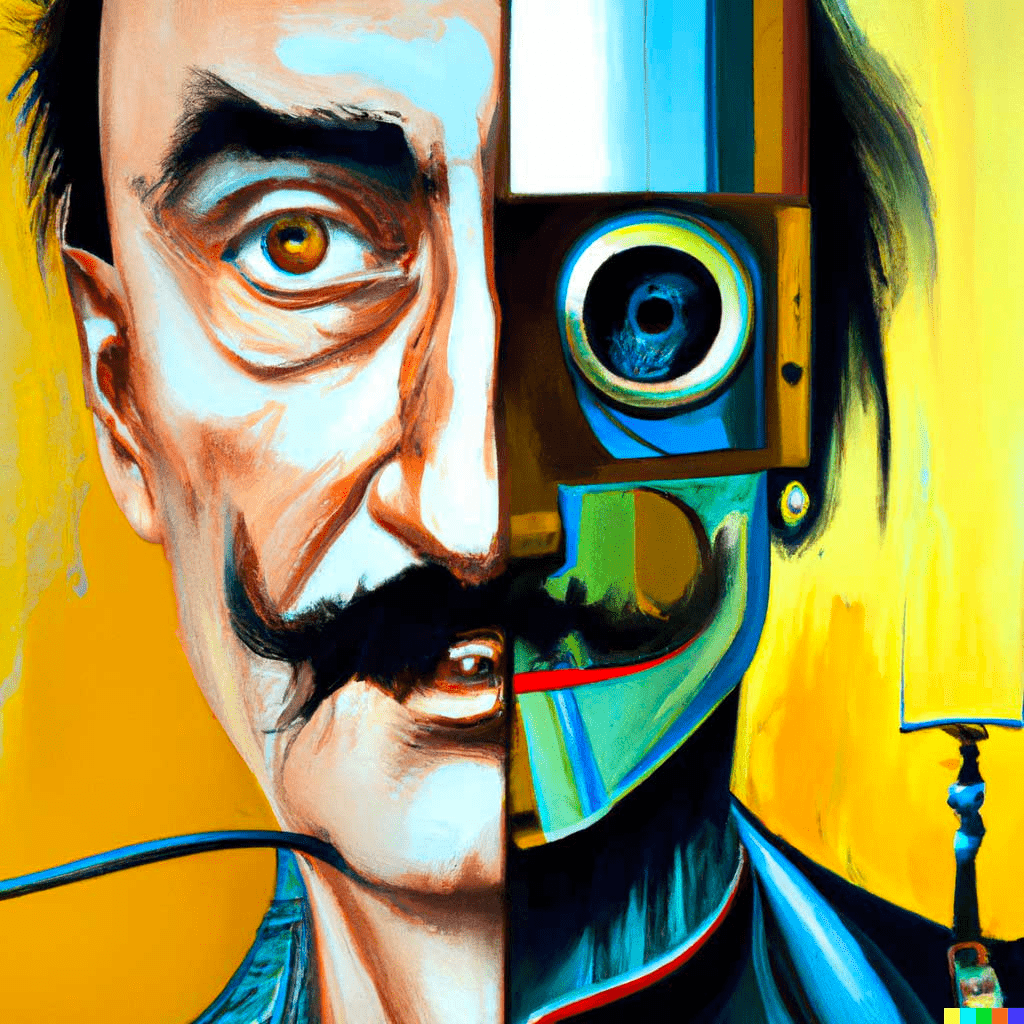

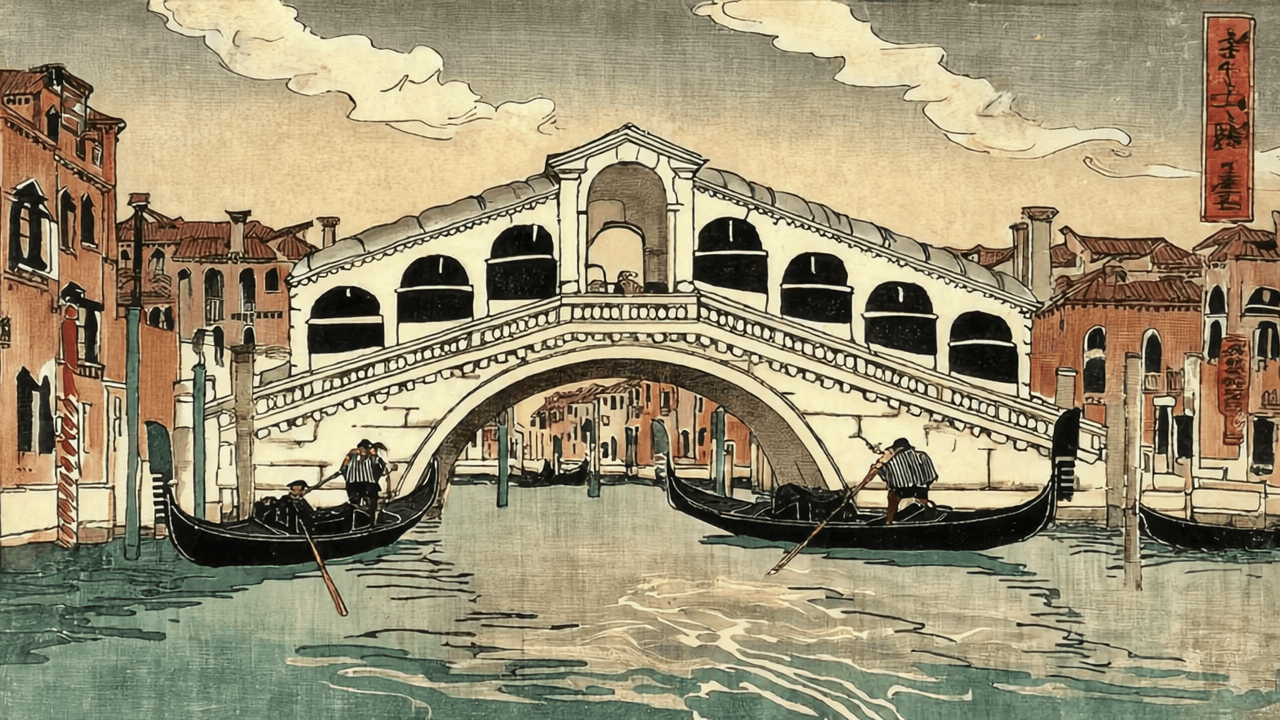

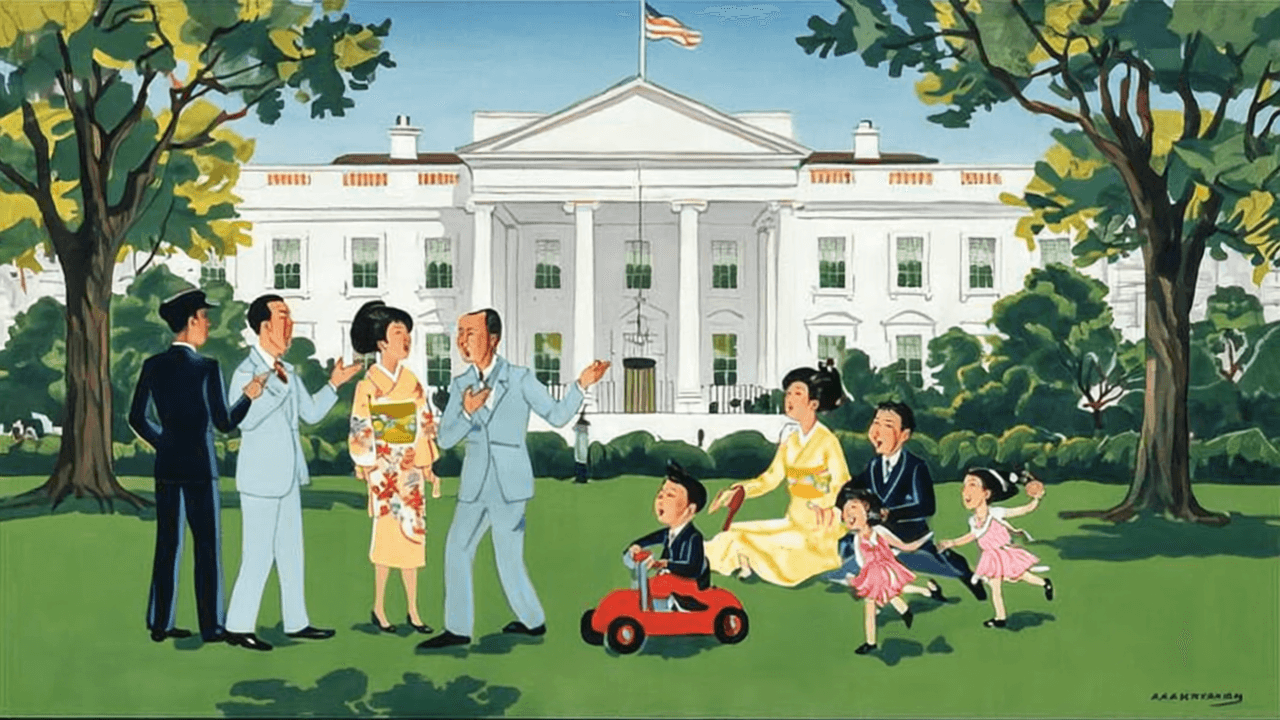

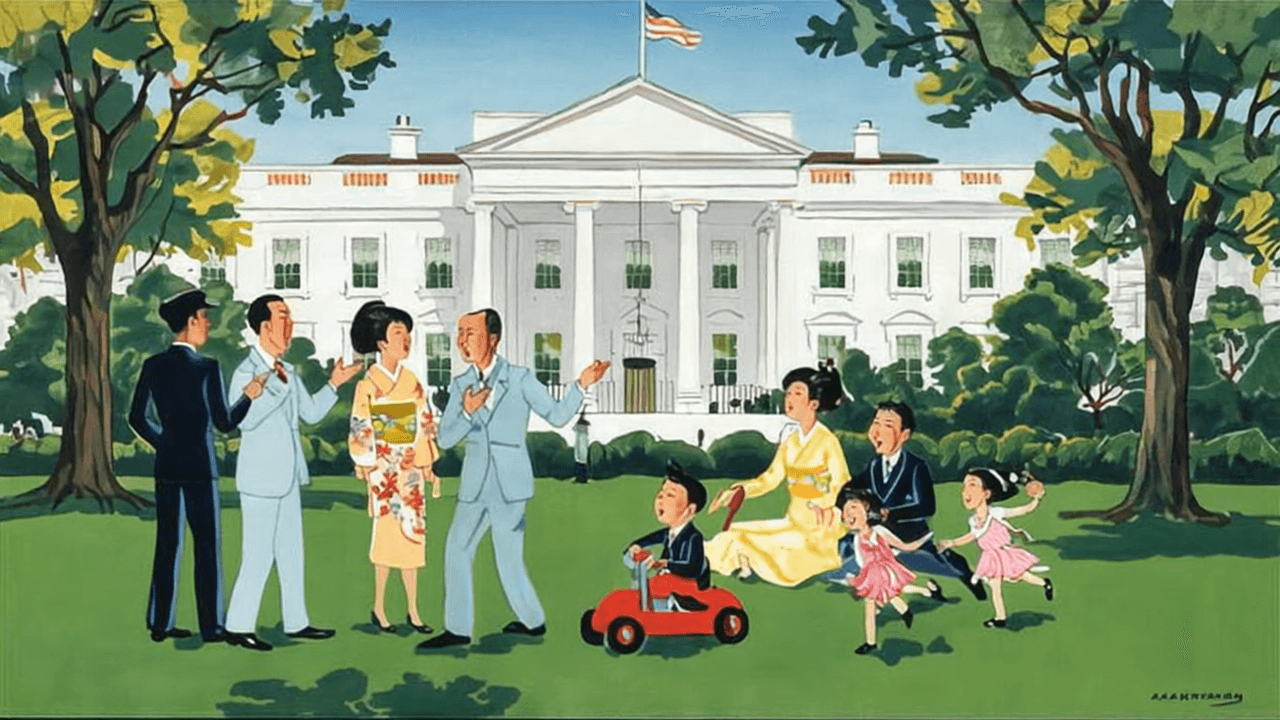

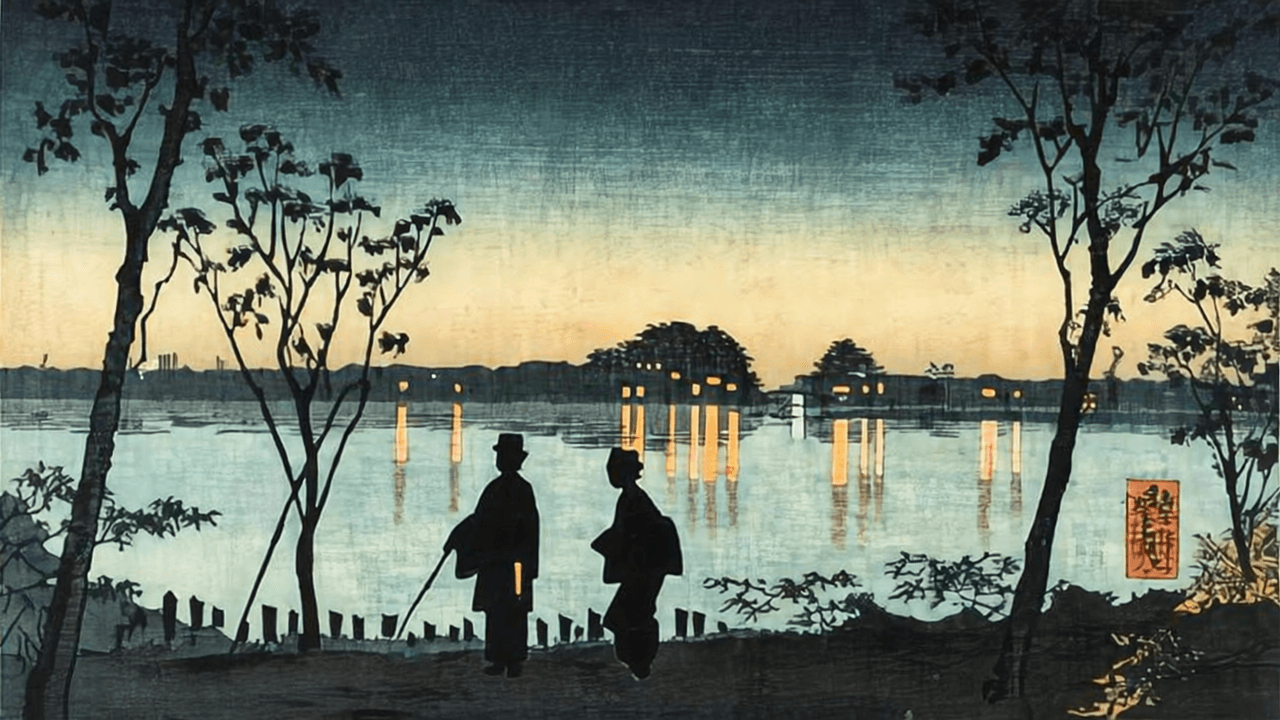

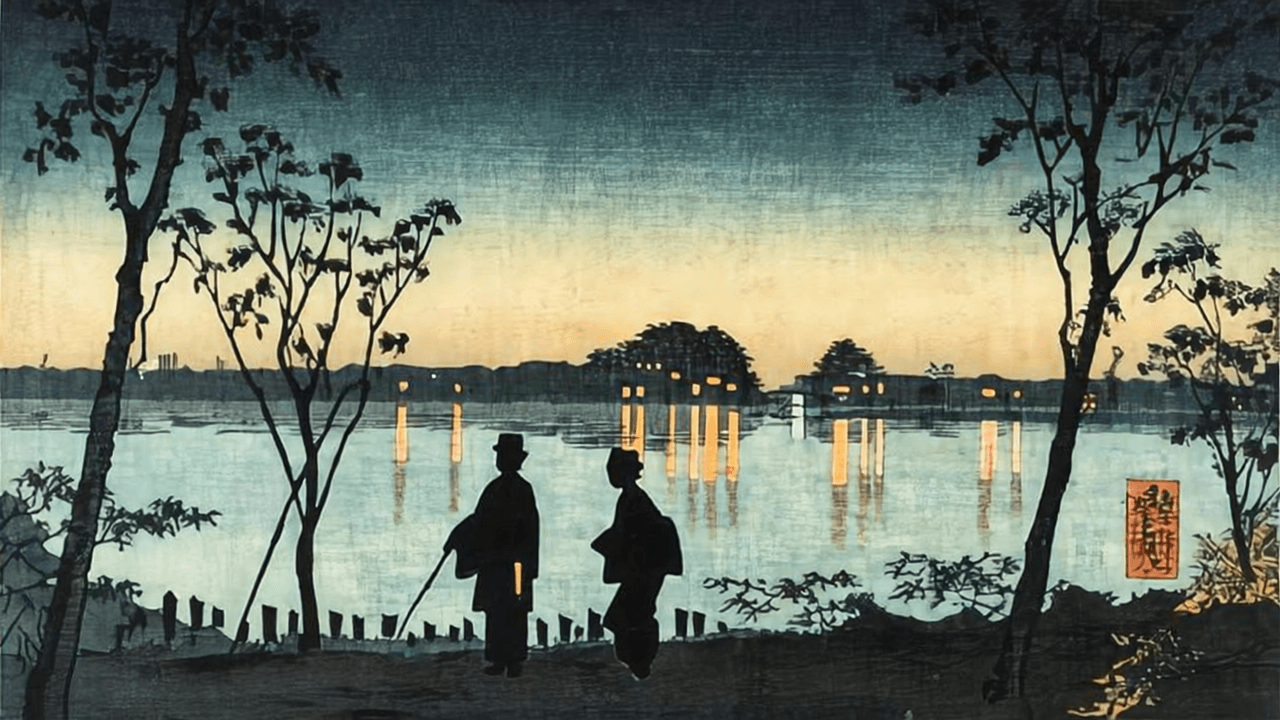

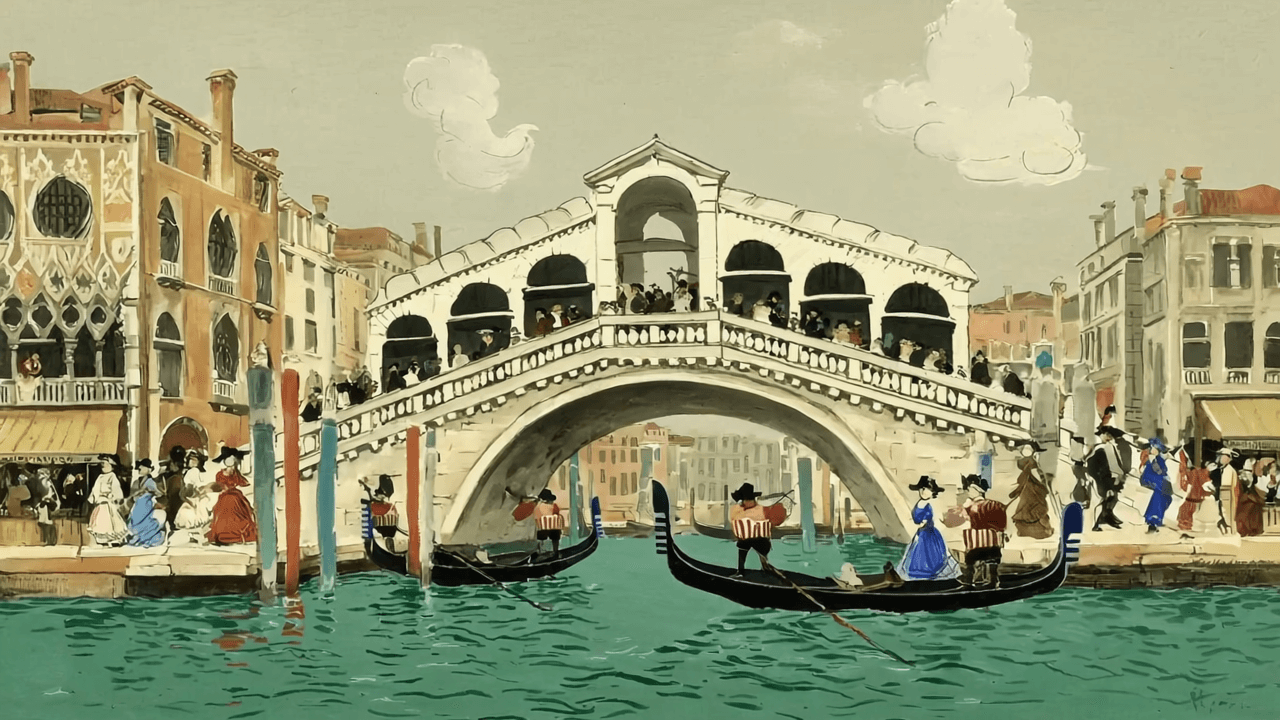

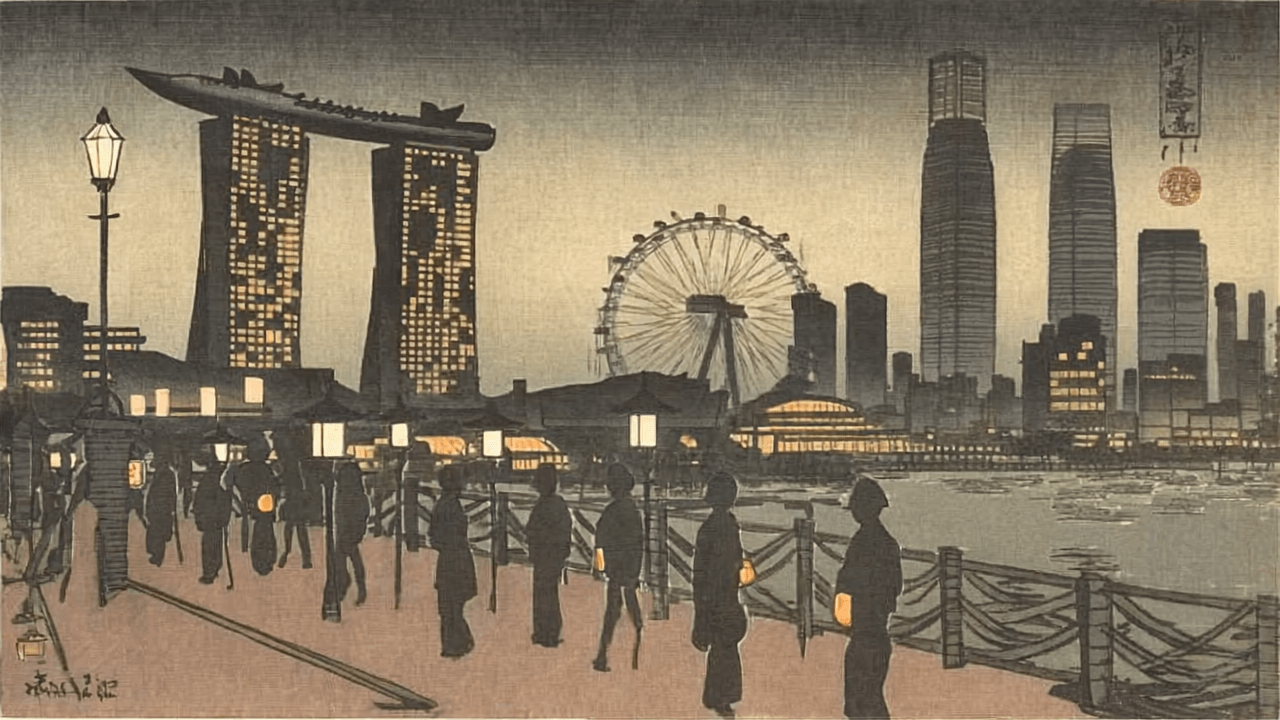

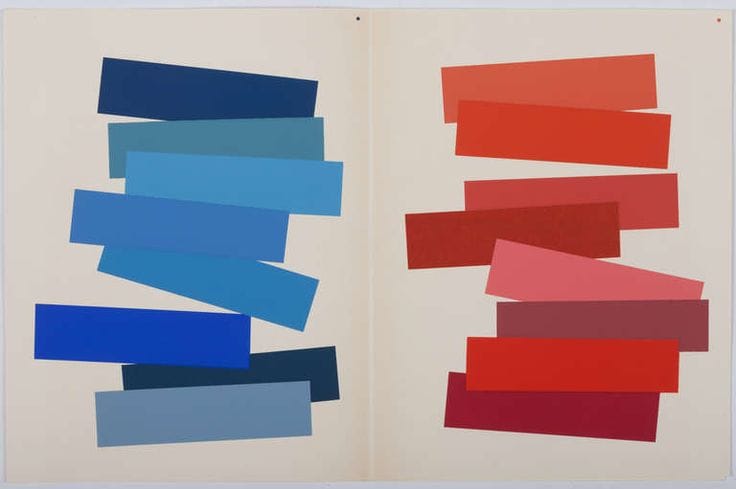

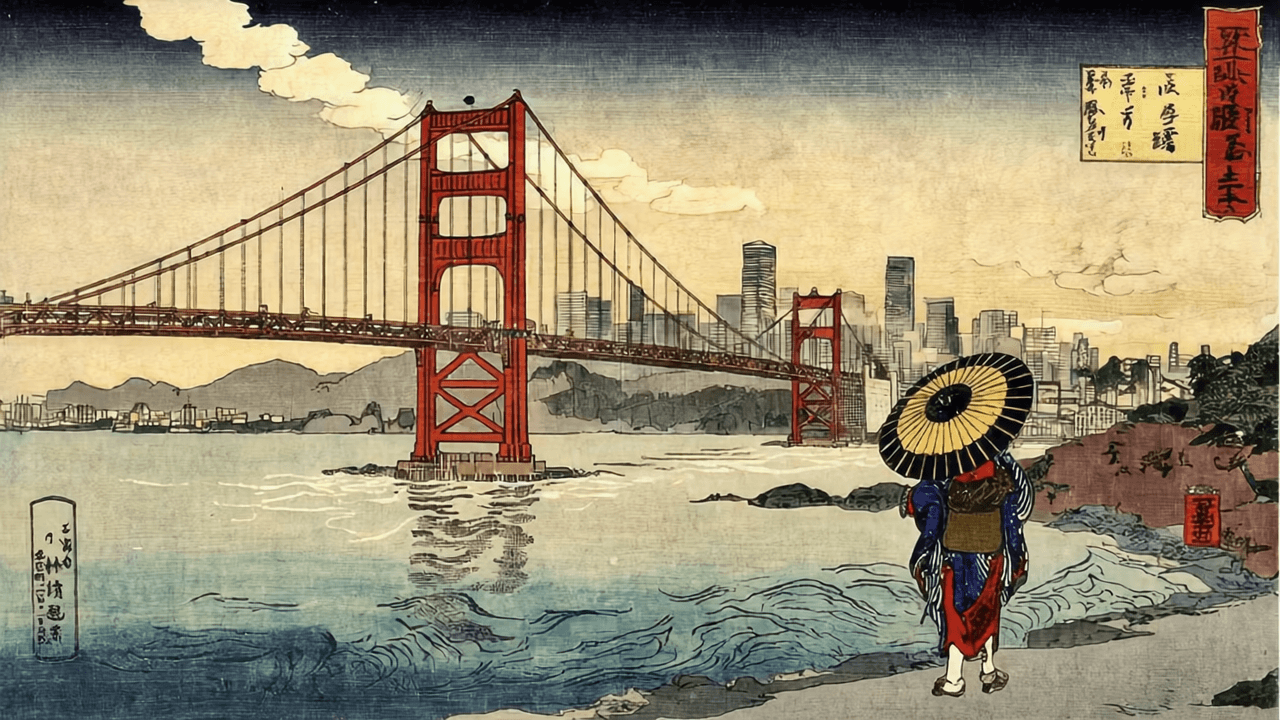

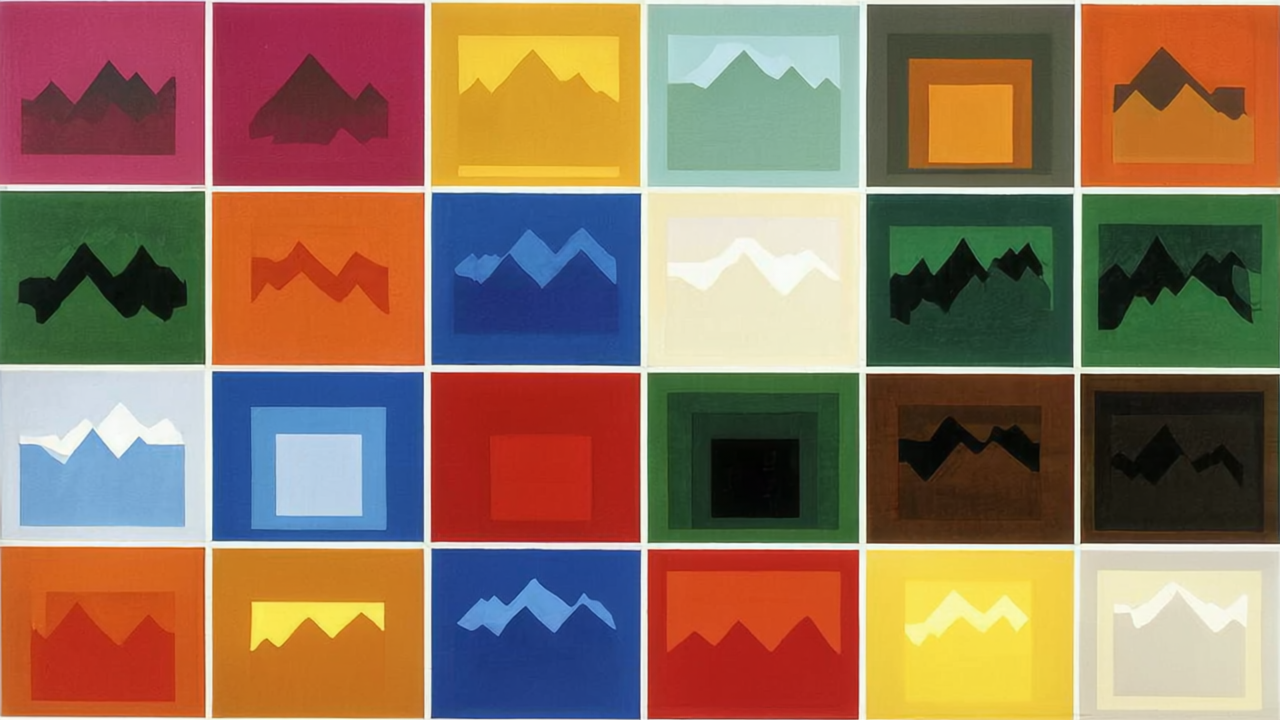

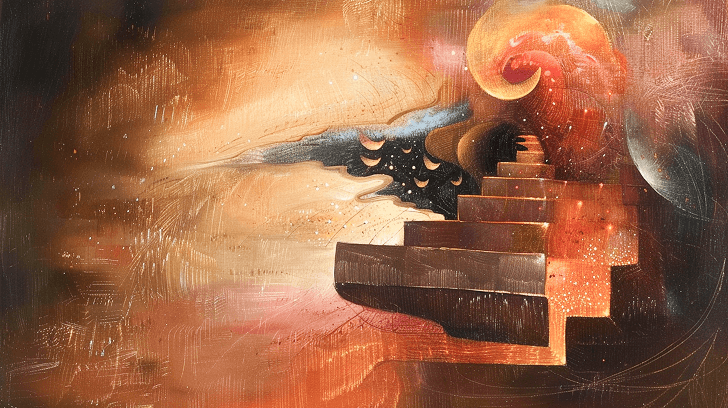

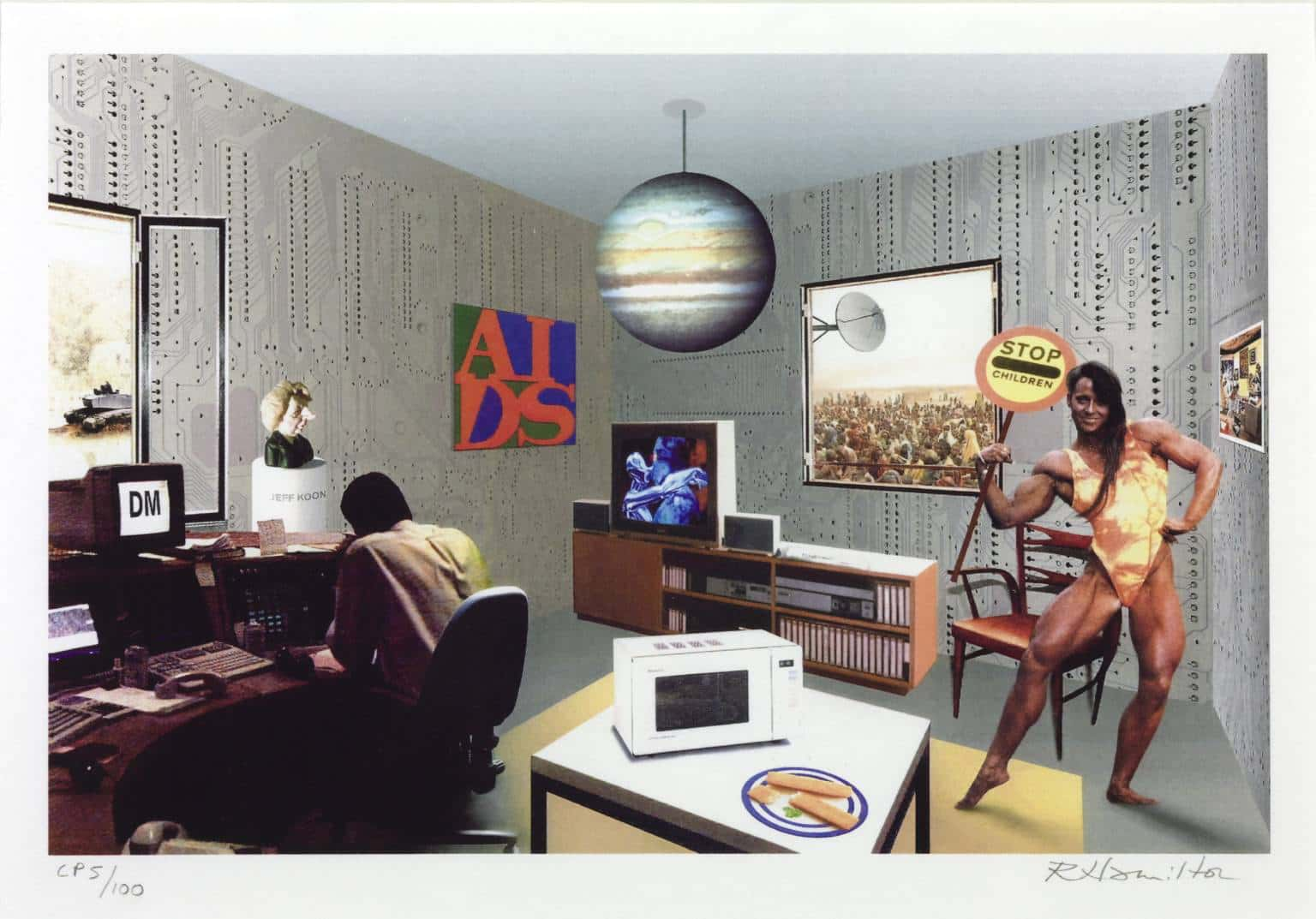

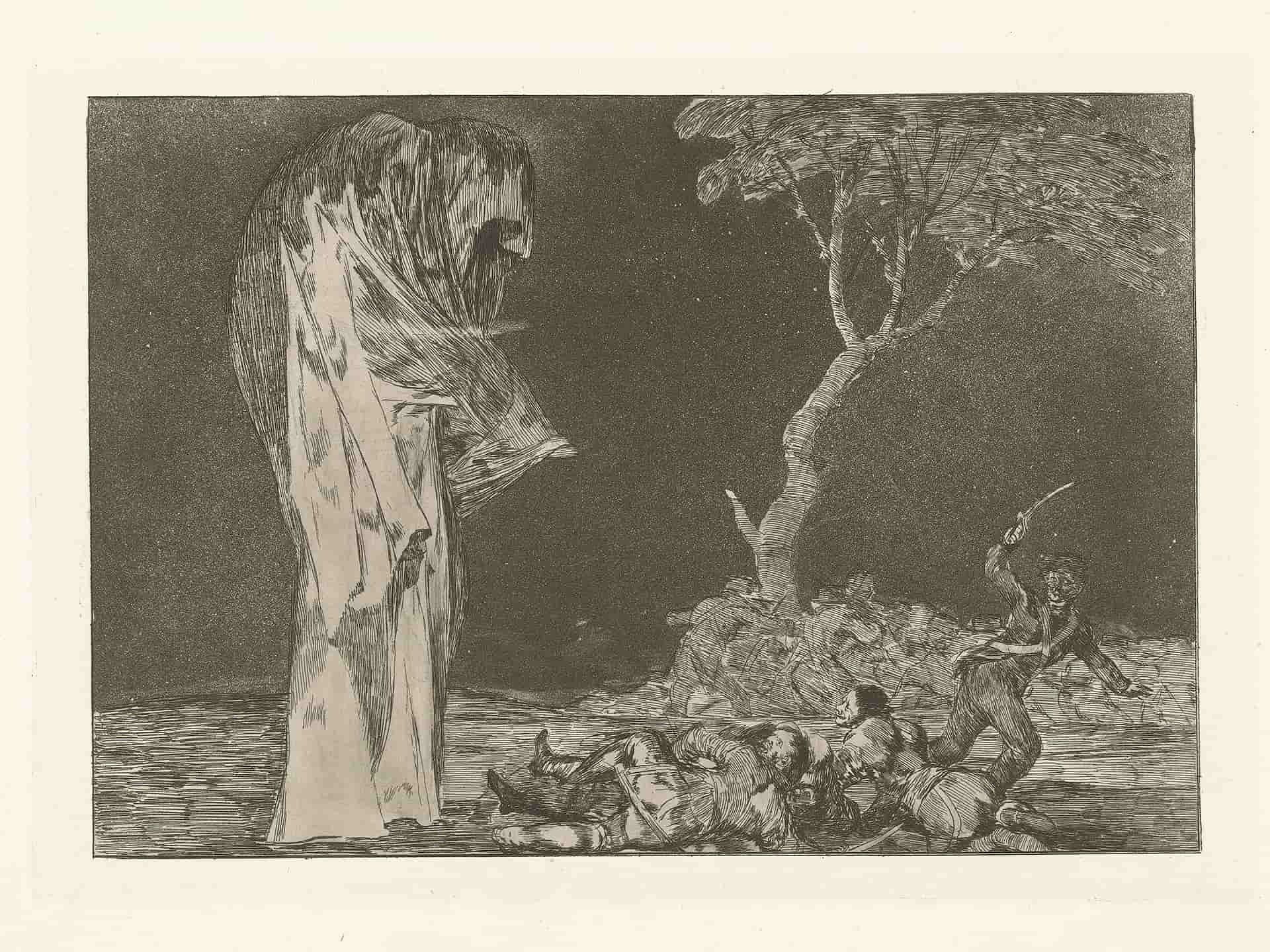

Zero-Shot Learning sin embargo, es la capacidad que tienen algunos modelos de hacer cosas para las que no fueron entrenados específicamente. Por ejemplo, DALL·E fue entrenado para generar imágenes a partir de texto. Pero con el mensaje de texto correcto, también puede transformar imágenes en dibujos, y hasta reproducir estilos de artistas famosos. Cosas que nunca antes había visto.

Uno puede pedir astronauta caballo en el espacio

Pero si se pide lo mismo, pero en el estilo de Andy Warhol, se obtiene:

A todo esto, ¿a quién debemos esta tecnología?

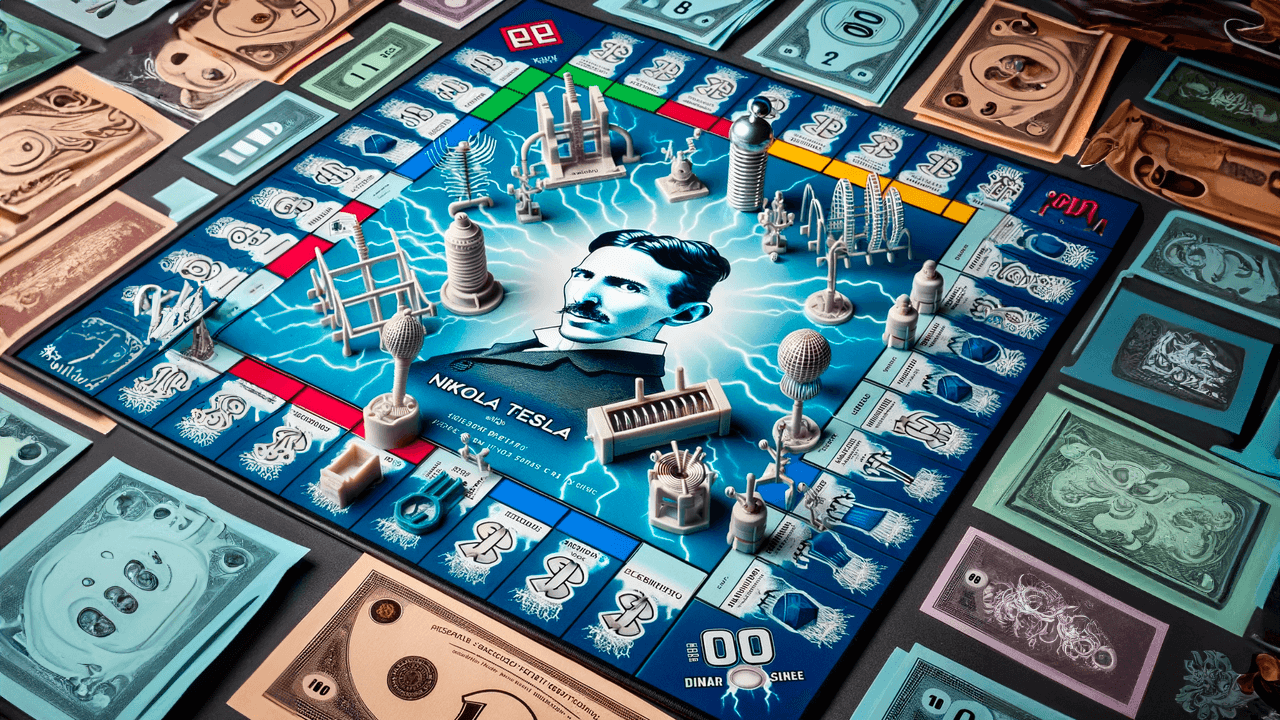

¿Qué es OpenAI, por qué se llama así y por qué quizás no debería tener ese nombre?

Es complicado. OpenAI surgió en 2015 de los sospechosos de siempre: Paypal mafia, Y Combinator y varios nombres conocidos.

Uno de ellos es Elon Musk, quien en el 2018 se sale del directorio para evitar conflictos de interés dados los trabajos de AI en Tesla, aunque se mantuvo como donante.

La idea de OpenAI era simple y estaba inspirada en el dilema del Basilisco de Roko: motivados por el temor de una inteligencia artificial que se fuera de las manos y pudiera terminar con la humanidad, era necesario una especie de organismo vigilante, creado como una entidad sin fines de lucro que se pudiera dedicar a la investigación para el beneficio de las personas.

Pero en el 2019 las cosas se complicaron cuando OpenAI se convirtió en una institución con fines de lucro. También en el 2019 las cosas se complicaron un poco más al publicarse un acuerdo entre OpenAI y Microsoft, donde Microsoft luego de invertir mil millones de dólares, pasa a ser su socio preferente y se opone a que OpenAI comercialice libremente licencias de sus descubrimientos.

Este alejamiento del espíritu original hace que no pocos en la comunidad de la inteligencia artificial vean a OpenAI con sospecha y les parezca irónico lo de “Open”.

Pero volviendo a esta maravilla que puede crear cualquier obra gráfica con solo un poco de texto.

¿Qué impacto tiene?

¿Es un aporte al mundo del arte o significa su muerte?

¿Significa el fin para los ilustradores?

No lo sabemos. Estamos frente a un comunicado de prensa sin mayor pruebas. En el futuro cercano será un producto accesible para algunos pocos como Elon Musk, y en el corto plazo seguramente estará disponible de forma comercial de una manera más extendida.

Pero ¿significa que debo guardar mis pinceles o mi tablet y dedicarme a otra cosa si dedique los últimos años a estudiar arte, diseño o ilustración?

No necesariamente.

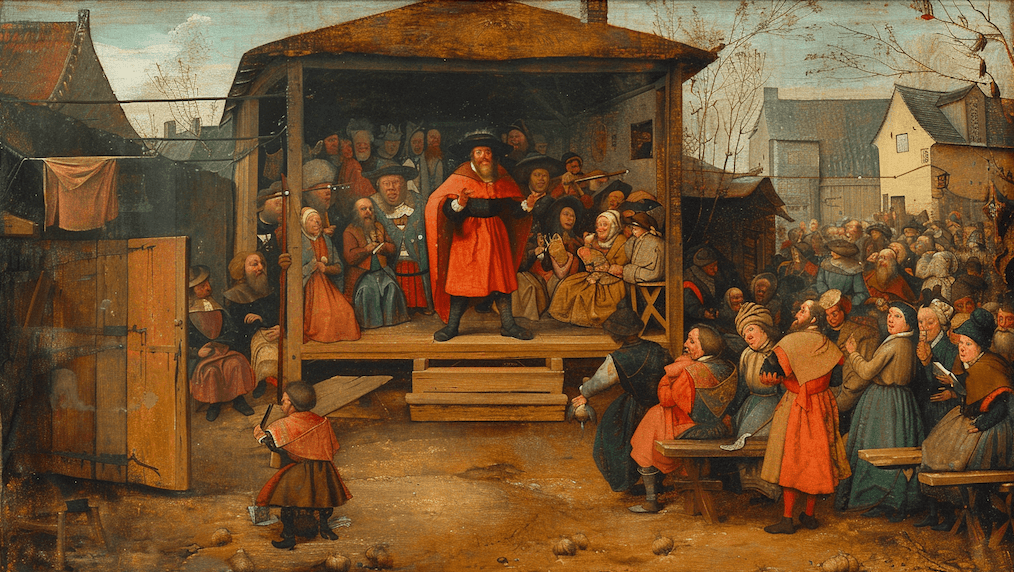

Así como no quedaron los pintores o dibujantes sin trabajo cuando se perfeccionó la fotografía y tampoco sucedió eso cuando se popularizó la ilustración digital. El arte seguirá siendo más sobre la personalidad de los artistas, la moda, los ángulos e interpretaciones que existen sobre la belleza. En este sentido, no basta con la capacidad de una máquina que imita y crea imágenes a partir de núcleos semánticos, por más alta que sea su definición.

En el futuro previsible el artista seguirá existiendo, aunque sea al menos para pensar qué textos le tiene que pedir a DALL-E.

Ojo: OpenAI no ha liberado la tecnología, pero ya hay algunos intentos de copia como DALL-E mini, que está lejos del nivel del original, pero vale absolutamente la pena probarlo.

Si te gustó este artículo y tienes un comentario o algo para complementarlo, escríbenos a cartas@fintual.com. Publicamos las más destacadas.