Hace unos días se publicó un estudio de la Universidad de Chile mostrando que el 81% de los estudiantes utilizan inteligencia artificial. Durante los últimos meses e incluso durante el último par de años se ha estado hablando muchísimo del uso de la inteligencia artificial en las universidades. Tal vez, la solución está en las llamadas “alucinaciones”.

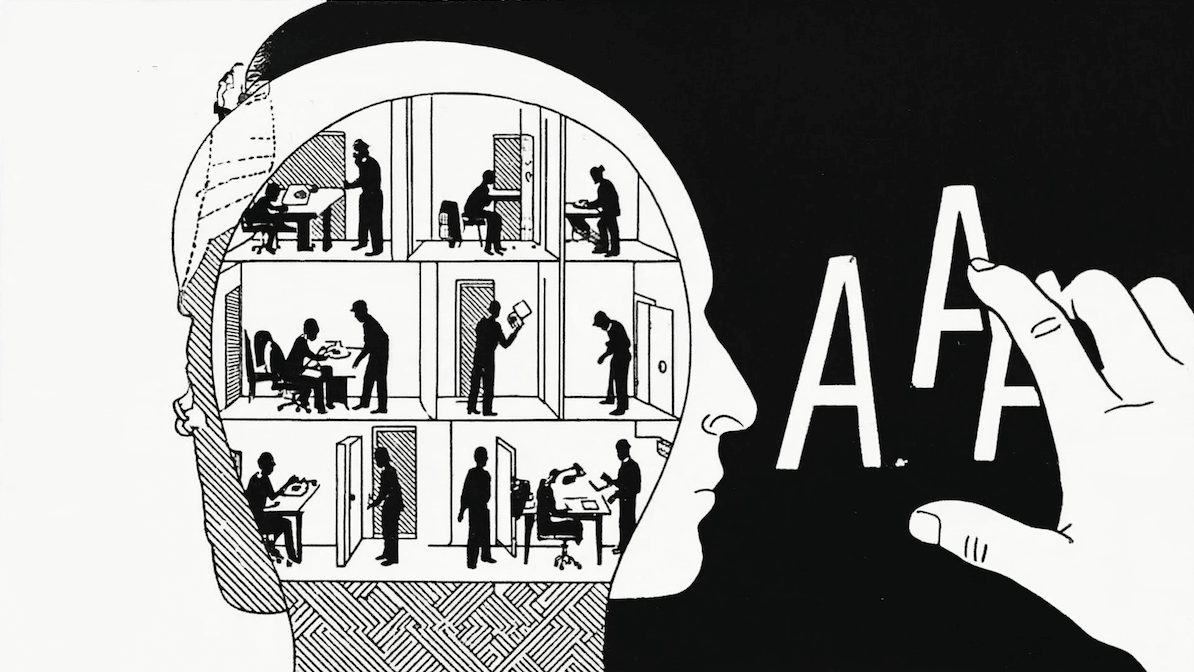

Hagamos la siguiente composición del lugar: un estudiante recibe una tarea de escritura en la universidad y, en vez de hacerla él mismo o ella misma, lo que hace es pedirle a una inteligencia artificial que la escriba. Se la entrega muy ufana o ufano al profesor, esperando que le ponga una excelente nota. Pero el profesor, a su vez, en vez de corregir el trabajo o el texto él mismo, le pide a otra inteligencia artificial que lo corrija. Y no solo eso, el profesor también ha hecho la tarea pidiéndole a la inteligencia artificial que la construya y le ha pedido asimismo que le haga una rúbrica. Después, aplica la rúbrica con IA para la corrección.

Por lo tanto, todo el proceso de elaboración de una actividad en la universidad, tanto del profesor como del estudiante, ha pasado por la inteligencia artificial de forma íntegra. Esto se parece a un chiste de Condorito, en que Condorito le pedía mil pesos a don Chuma y no tenía cómo devolvérselos. Entonces le pedía a Huevoduro que le prestara a su vez mil pesos para devolvérselos a don Chuma, y a la siguiente semana, para devolverle a Huevoduro lo que le había prestado, le pedía a don Chuma que le pasara los mil pesos de nuevo a él. Cuando llegó Condorito como a la octava iteración, decidió juntar a don Chuma con Huevoduro y les dijo: “Por favor, don Chuma, dale mil pesos a Huevoduro el lunes; y Huevoduro, dale mil pesos a don Chuma el viernes, y ahí todos contentos”.

Es un poco la misma idea: la inteligencia artificial haciendo la pega por todos nosotros.

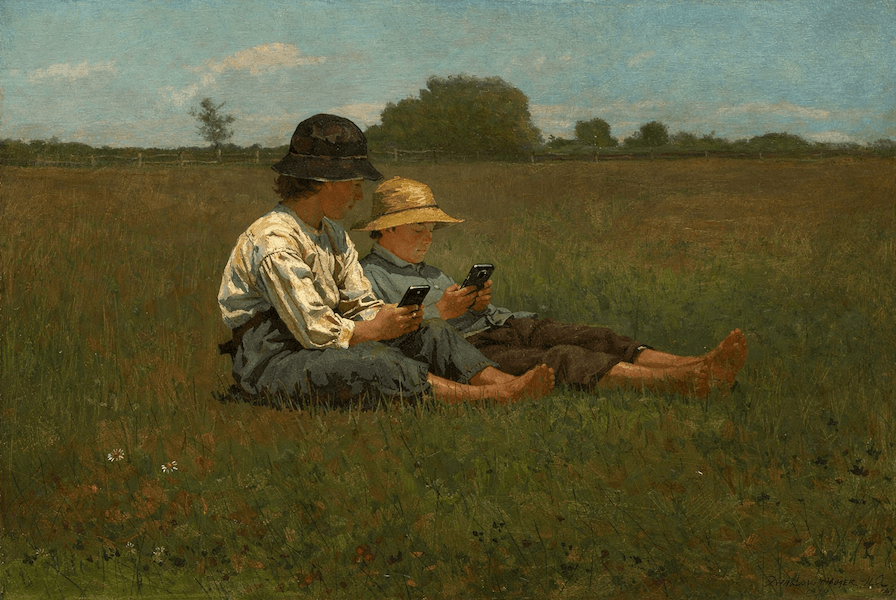

Creo que más allá de la anécdota, que es fantasiosa, todavía hay algo que poner sobre la mesa. Los estudiantes han copiado siempre. Pensemos que antes copiaban de Wikipedia, antes de eso copiaban del Rincón del Vago o Mis Tareas. Antes de eso, copiaban de una revista que se publicaba y se ponía en los quioscos y librerías en que vendían escuadras y compases, que se llamaba “Apuntes para el estudiante”. Antes de eso copiaban de la revista Mampato —de las separatas que traía la revista Mampato con uniformes militares de la Guerra del Pacífico o el mapa geográfico de Chile con las provincias que producían más sandía o cosas de ese estilo—. Antes, incluso, los estudiantes copiaban de la pizarra lo que el profesor, a su vez, copiaba de un libro, como bien dijo alguna vez Anne-Marie Chartier en un artículo precioso para la revista Lectura y Vida del año 2009. Por lo tanto, copiar o hacer una modificación u ocupar otro elemento, como por ejemplo de la Enciclopedia Encarta para hacer los trabajos, es una cosa que ha existido siempre.

En ese sentido, lo que hace hoy en día la inteligencia artificial es simplemente hacer una copia un poco más sofisticada. Como lo dijo alguna vez Noam Chomsky en un texto para el New York Times: en el fondo son formas de copia muy elaboradas, pero no más que eso.

Recuerdo que mi primer encuentro como profesor universitario con la copia descarada de Internet en la universidad ocurrió el año 2002, cuando hacía clases de escritura a estudiantes de Diseño en la Universidad Diego Portales. El trabajo final consistía en escribir un texto sobre el surrealismo, y el 80% del curso copió un mismo artículo del Rincón del Vago sobre el tema. Lo curioso es que este artículo del Rincón del Vago había permutado o invertido la posición del 9 y el 2, por lo tanto, en vez de decir que había comenzado el surrealismo en 1924, decían que el surrealismo había comenzado en 1294, lo que era un error que estaba en el texto del Rincón del Vago.

Luego me tocó la Wikipedia, y hubo todo un escándalo sobre sus usos en la universidad, que incluso llegó a ser noticia en El Mercurio y La Tercera.

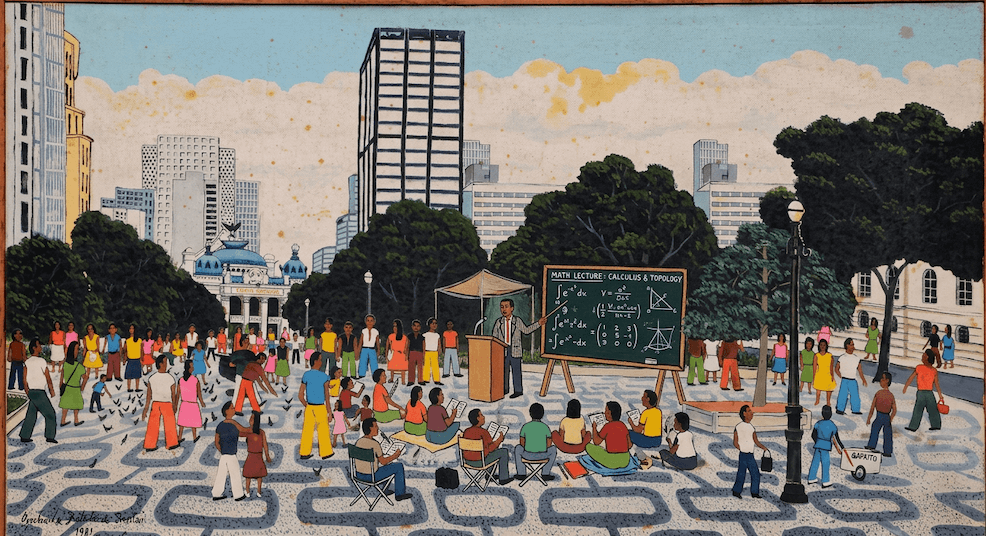

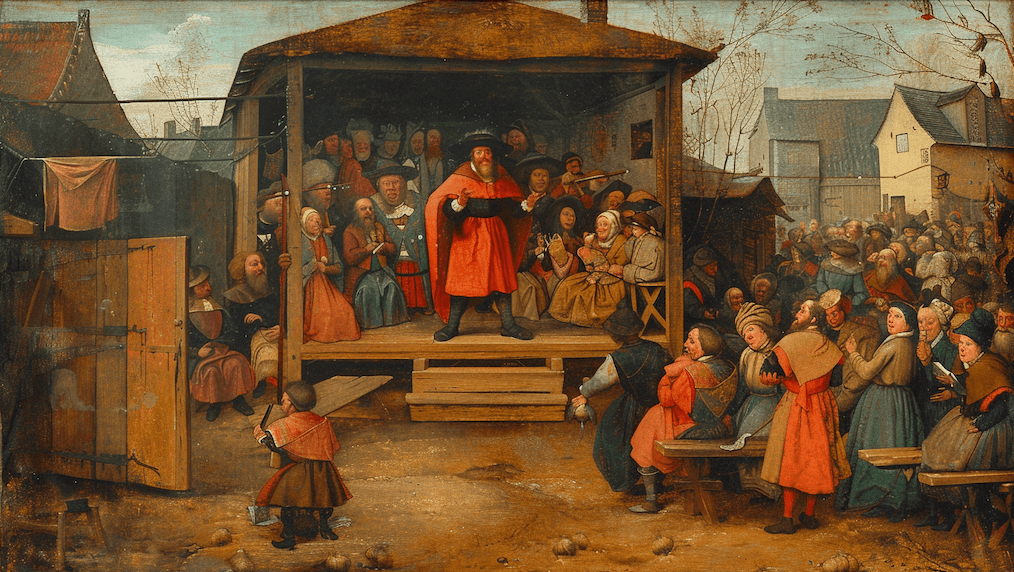

Entonces, tuve una idea, quizás una idea genial: “si ustedes sacan la información de la Wikipedia y hacen su trabajo, ¿por qué no lo hacemos al revés?, y hacemos que la gente meta la información en la Wikipedia”.

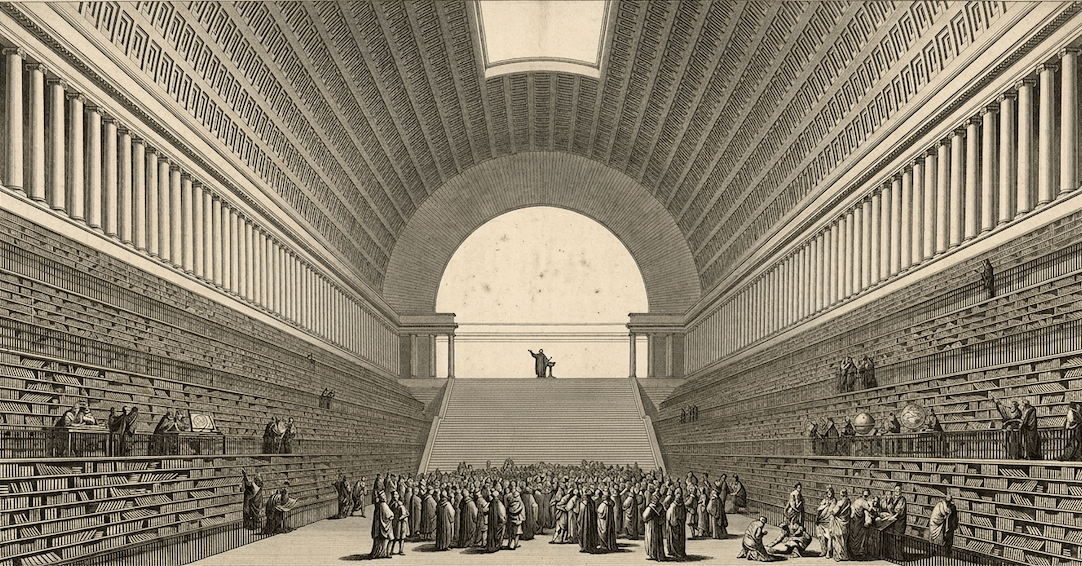

Por lo tanto, mi primera tarea moderna sobre escritura, o la más importante que hacía en el semestre, la prueba solemne o el certamen, dependiendo de la universidad, consistía en escribir un artículo para subirlo a la Wikipedia. Eso fue en marzo de 2006.

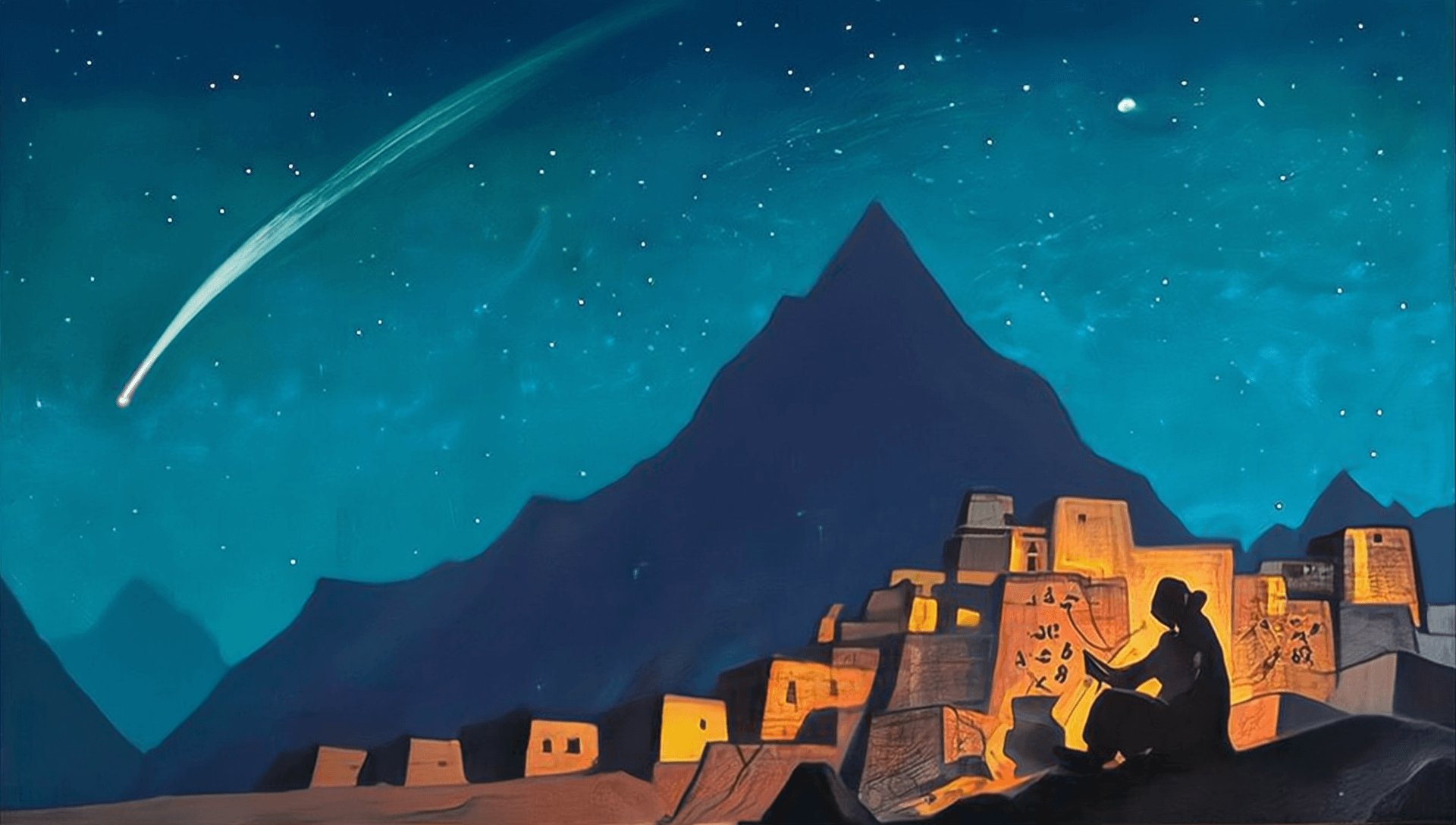

En marzo de 2006, estudiantes míos escribieron el artículo original sobre Jorge Teillier, sobre Enrique Lihn, sobre Rodrigo Lira, sobre “Carta a una señorita en París”, y otras cosas por el estilo, para Wikipedia.

Estimo que en las decenas de cursos de este tipo que he hecho, donde han pasado al menos unos dos mil estudiantes, finalmente en la Wikipedia han quedado medio millar de textos escritos por ellas y ellos.

Textos todos muy fascinantes, y que impedían que hubiera plagio, porque la Wikipedia cuidaba eso religiosamente, y en el fondo ya no era robar, sino colaborar.

En el año 2015, a partir de estas experiencias, que ya llevan dos décadas, participé en un congreso de la Wikimedia Foundation en Chile, que se hizo en la Biblioteca Nacional, y le puse a mi ponencia “No robe, colabore”. Por lo tanto, había encontrado quizá, y no era el único, una solución para el plagio o la copia.

De hecho, hubo otro profesor, de ciencias físicas de la Universidad de Chile, que había hecho lo mismo: les pidió a sus estudiantes que escribieran sobre los grandes físicos chilenos, y por lo tanto, hacía que la Wikipedia no nos diera la información, sino que darles nosotros, y particularmente nuestros estudiantes, la información a la Wikipedia.

Ahora me pregunto: ¿Se podrá hacer lo mismo o algo equivalente a lo que hice con la Wikipedia con Meta AI o con ChatGPT? [Mi mamá, entre paréntesis, dice que Meta AI es lo peor porque Meta AI suena como “Meta Ahí”] Vuelvo, ¿se podrá hacer algo análogo con Meta AI o con ChatGPT o con DeepSeek a lo que hice con la Wikipedia?

Y hoy día mi respuesta es sí.

Se sabe que las inteligencias artificiales generativas que surgen después de ELMo, BERT, etcétera —he escrito sobre estas cosas en diversas ocasiones en distintos artículos para distintos medios— lo que hacen es simplemente generar datos a partir de estadísticas, como dice un artículo del New Yorker que habla de “la siguiente palabra”, que es muy interesante y que les recomiendo leer.

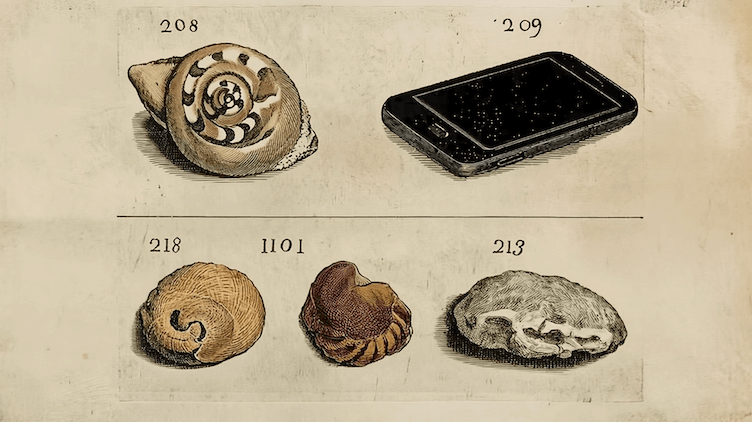

Esta generación de texto a partir de todos los textos que ha consumido el sistema es finalmente algo que produce respuestas para todo tipo de preguntas a partir de centenares de miles de millones, o billones, de palabras consumidas por el sistema. Pero en este consumo, las respuestas a algunas preguntas pueden ser respuestas erróneas. Las inteligencias artificiales alucinan, o como diría Philip K. Dick, “los androides sueñan con ovejas eléctricas”.

Por lo tanto, si un estudiante copia una información de estos sistemas, estos sistemas pueden darle información que es factualmente falsa. ¿Por qué? Porque se basa solamente en palabras, no se basa en hechos de la realidad, que es lo que decía el artículo extraordinario de Amanda Gefter sobre Walter Pitts, o el texto de Emily Bender sobre los Stochastic Parrots, o el texto de Edwin Hutchins “Cognition in the Wild” de hace treinta años.

Bueno, vuelvo al tema. Las inteligencias artificiales generativas tienen alucinaciones. Por lo tanto, yo plantearía que lo que tiene que hacer el profesor es simplemente detectar si hay alucinaciones en los textos. Por ejemplo, cosas como que tú le preguntes quién es Don Francisco y que te conteste el sistema alguna tontera como que es un humorista boliviano.

Tú podrías hacer algo tal como descontar dos puntos por alucinación. O sea, déjalos que escriban copias de inteligencia artificial, pero castígalos mucho si la inteligencia artificial está mintiendo. Esa sería una forma sancionadora de hacerlo.

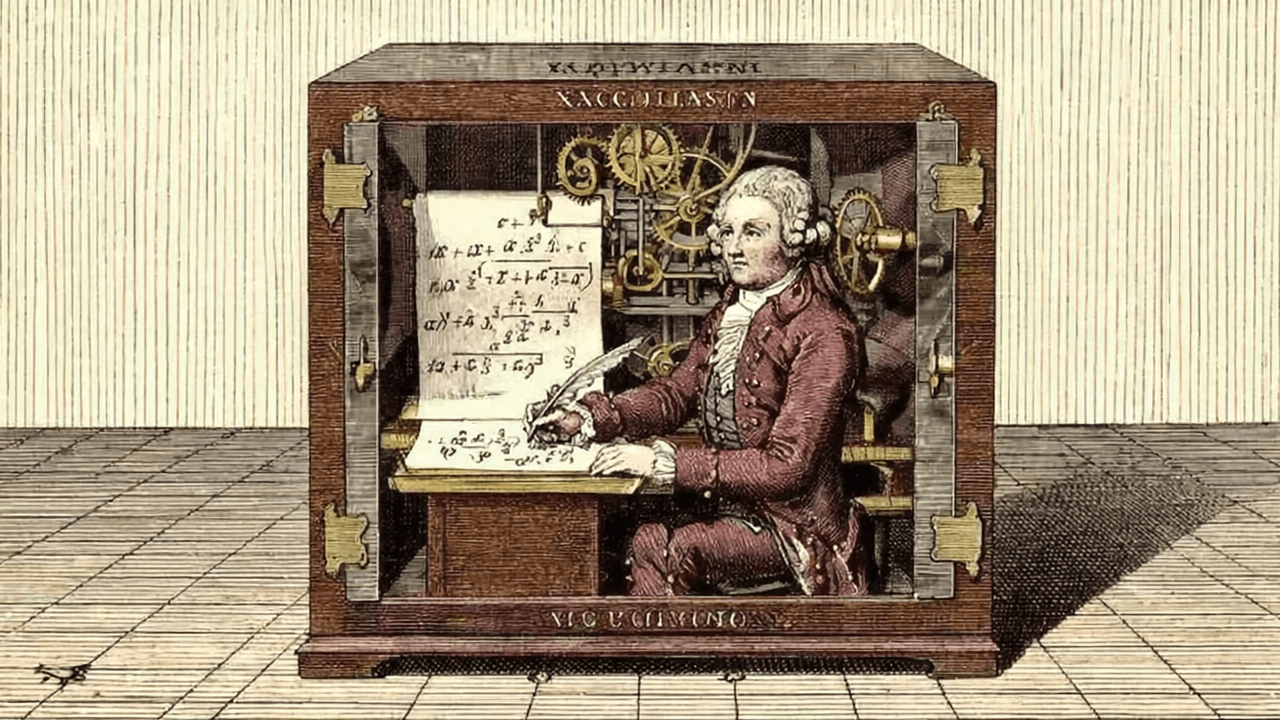

Pero hay una forma no sancionadora, que es pedirle que escriban cosas que se apoyen en la inteligencia artificial, pero que en notas al pie o en comentarios al texto digan dónde la inteligencia artificial se cayó. Eso les va a dar más pega, y finalmente van a hacer algo parecido a la Wikipedia. Sería algo similar a lo que se llama RLHF. ¿Qué es el RLHF? sigla que significa “Retroalimentación Humana de Refuerzo” en inglés. La retroalimentación humana por refuerzo lo que hace es que toma lo que sale de la inteligencia artificial como respuesta en los LLM y la filtra según criterios humanos para poder empezar a afinar la puntería de estos sistemas.

Los estudiantes estarían haciendo algo parecido a ello, y por lo tanto, participarían del sistema de forma análoga a como lo hicieron con la Wikipedia. Finalmente, esa es mi solución: hacer que los humanos vuelvan a tomar el control de las cosas. O, en el caso más sancionador, que el profesor sancione cuando descubra que las cosas están funcionando mal, porque, como sabemos, los robots sueñan con ovejas eléctricas.