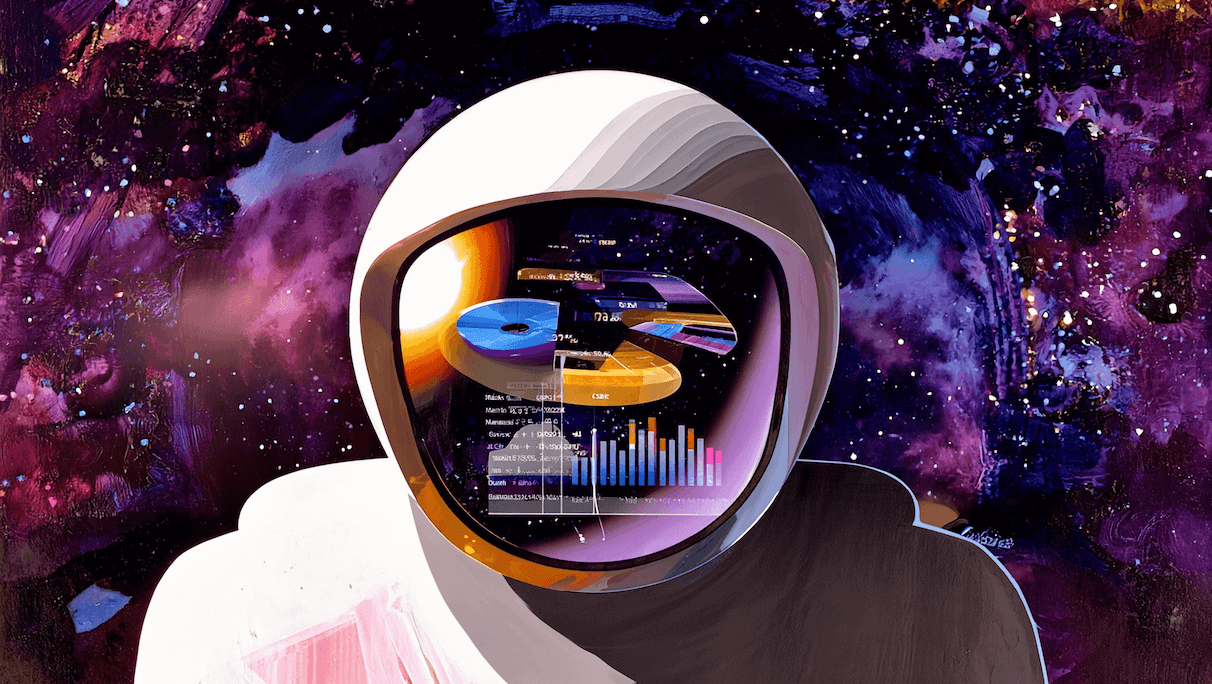

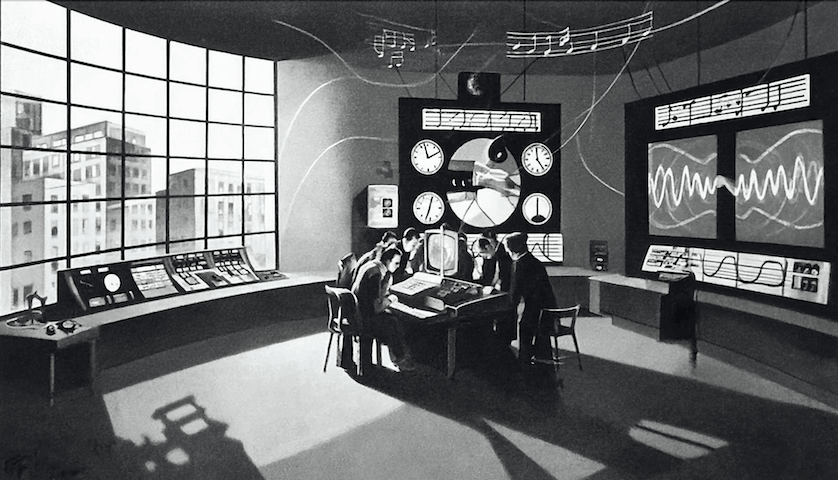

La inteligencia artificial, la realidad virtual y las experiencias inmersivas preocupan también a artistas que intentan estar al tanto de estas problemáticas. Es normal ver cada vez más películas sobre estos temas, pero también a autores que ven estas tecnologías como oportunidades para narrar.

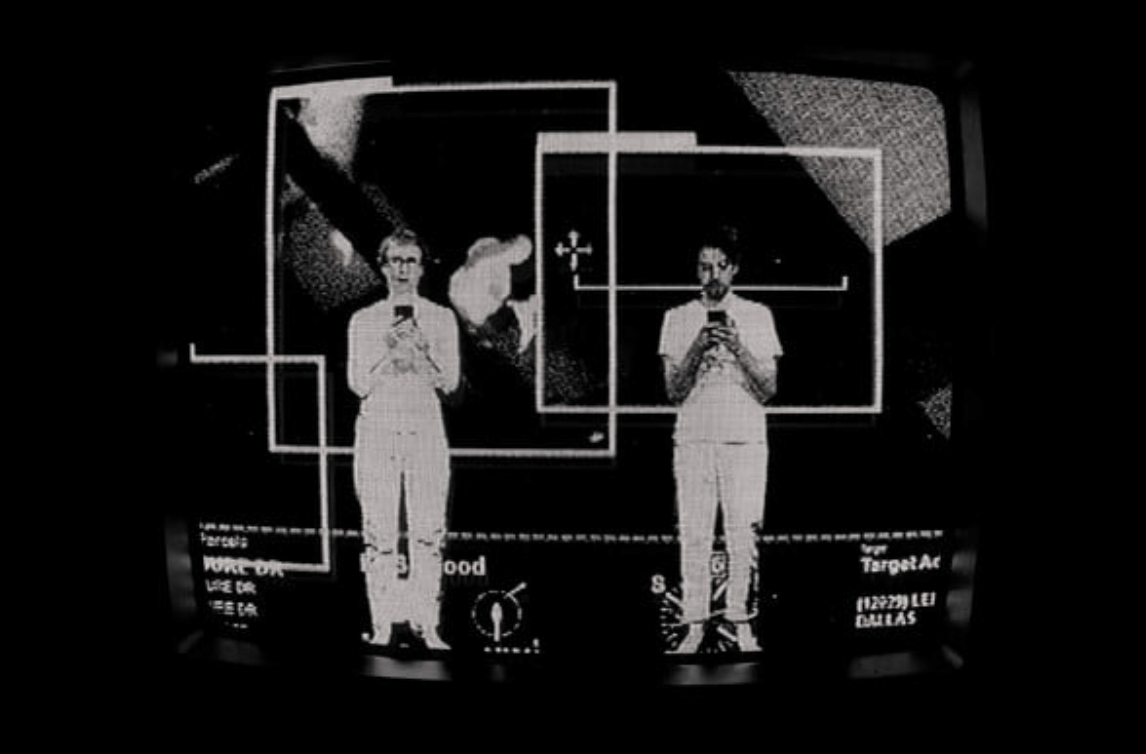

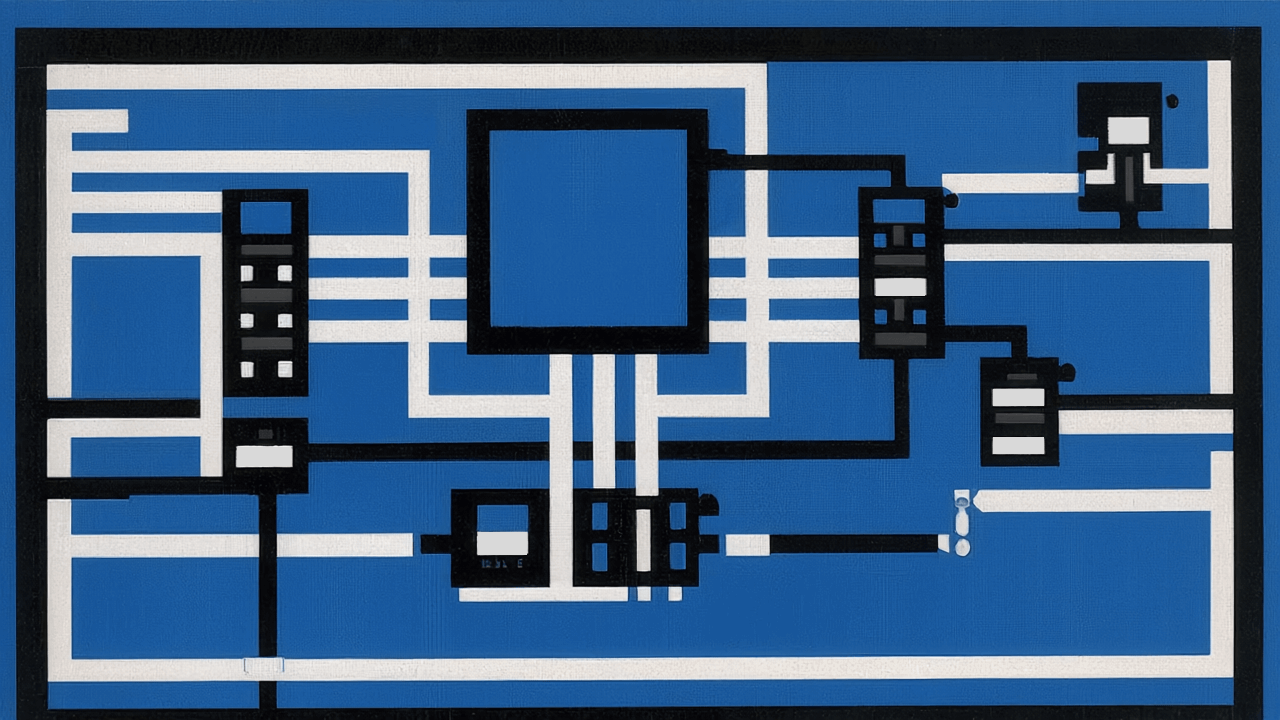

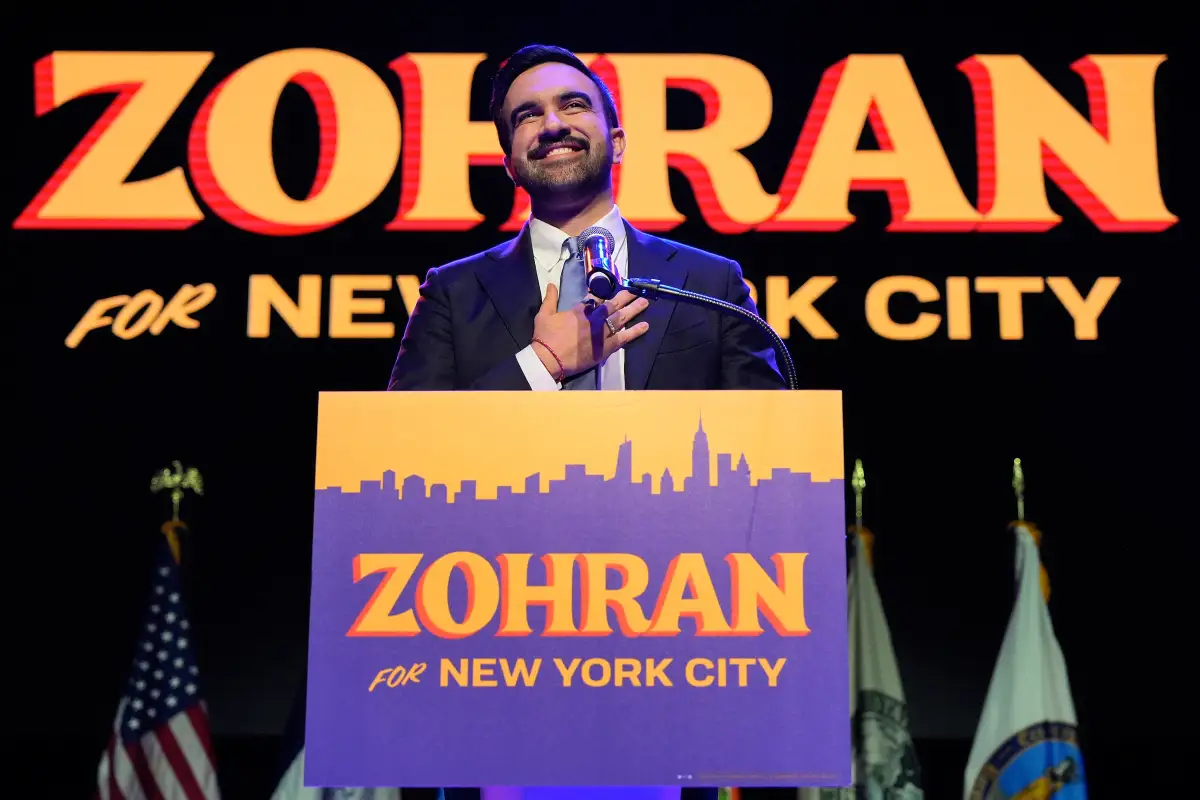

El festival de cine Films of the Future está interesado en estas vanguardias. Su más nueva edición ya se está llevando a cabo en Santiago de Chile y durará hasta el 15 de junio. Dentro de este marco ya vimos y podemos recomendar una de las piezas que se mostrarán este lunes: Computer Vision, del director chileno Camilo Salas, que muestra la distopía de los extremos en que la vigilancia se ha integrado en el mundo real.

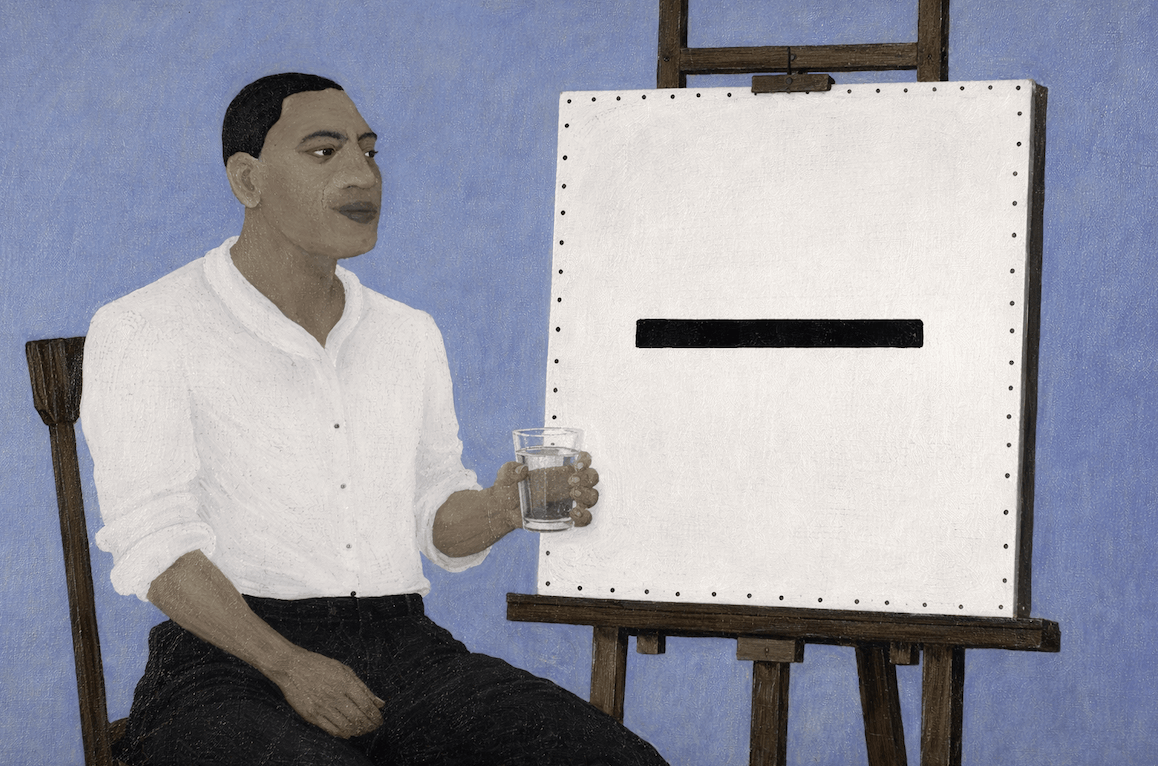

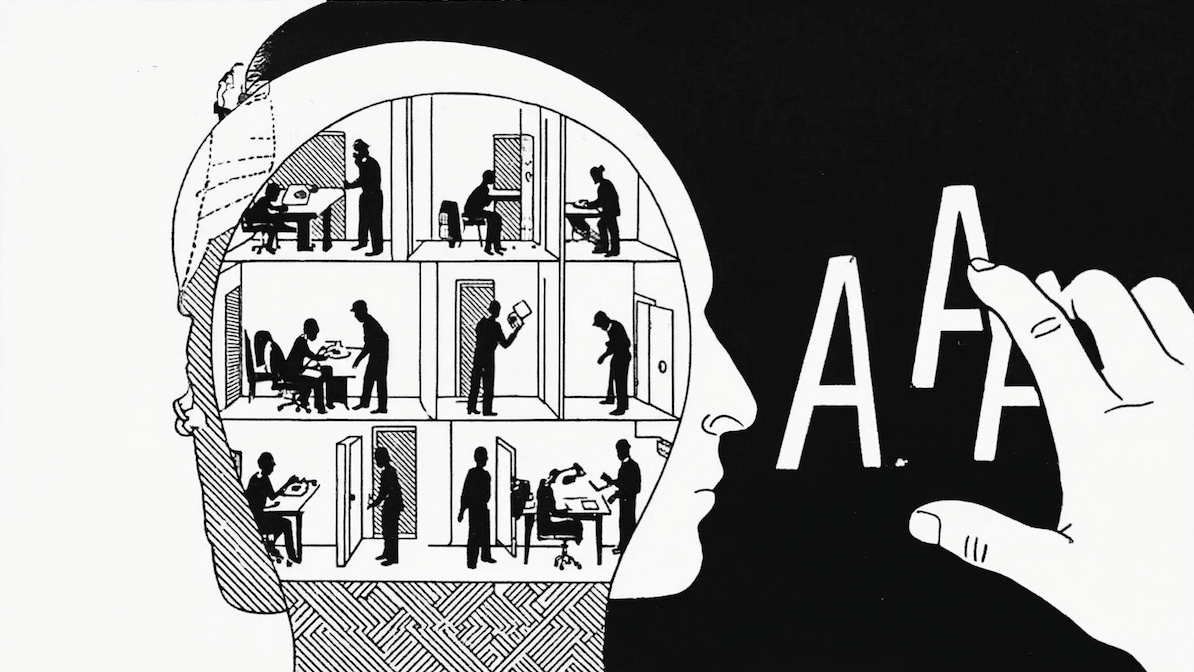

Lo primero que le respondí al director radicado en Nueva York cuando me preguntó qué me pareció su película fue “me dio miedo”, y es porque su documental, que mezcla aspectos experimentales y de performance, explora cómo cámaras omnipresentes nos están observando constantemente sin nuestro consentimiento.

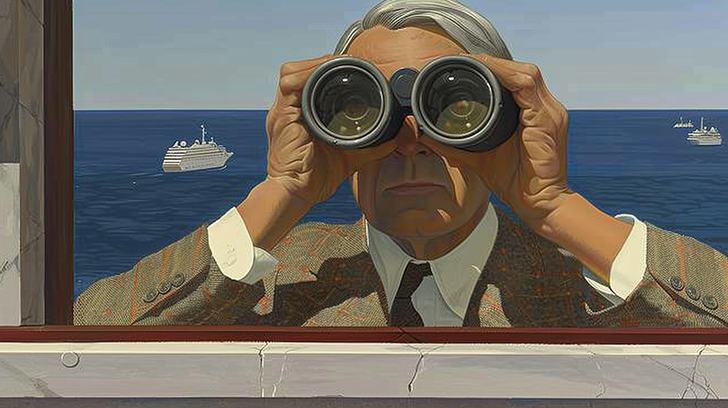

Cámaras que no consentimos predicen nuestro comportamiento

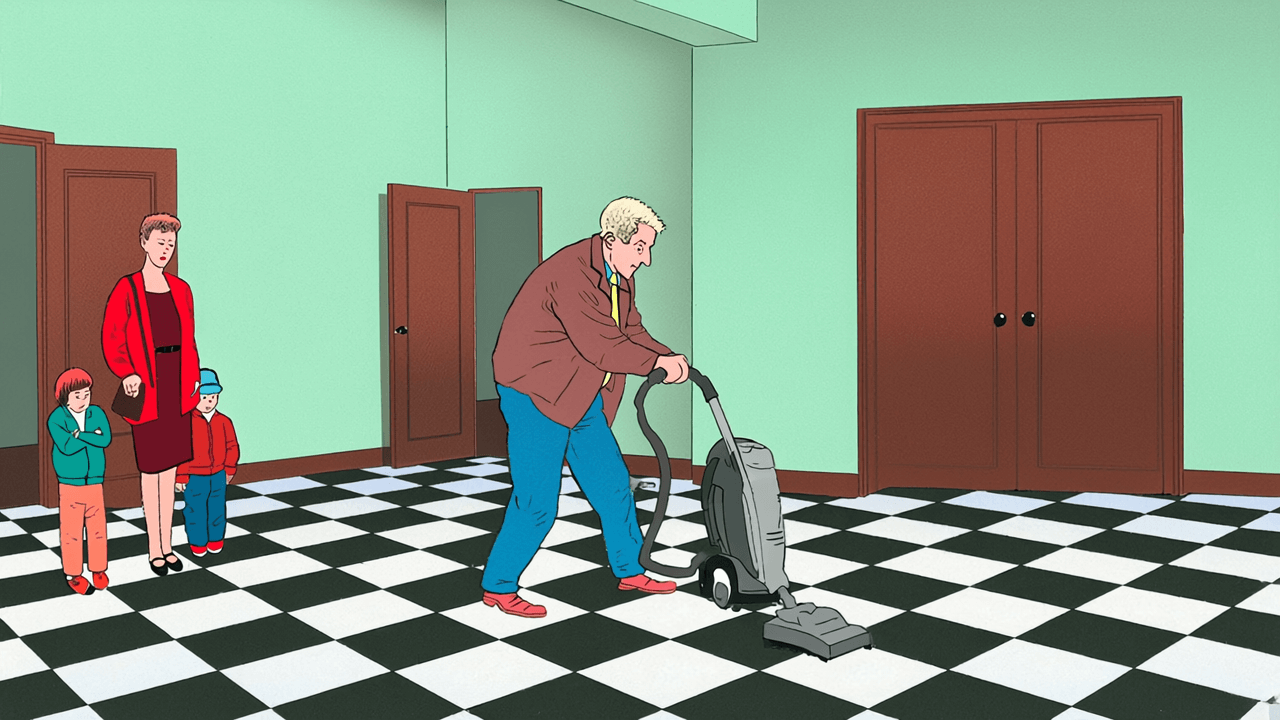

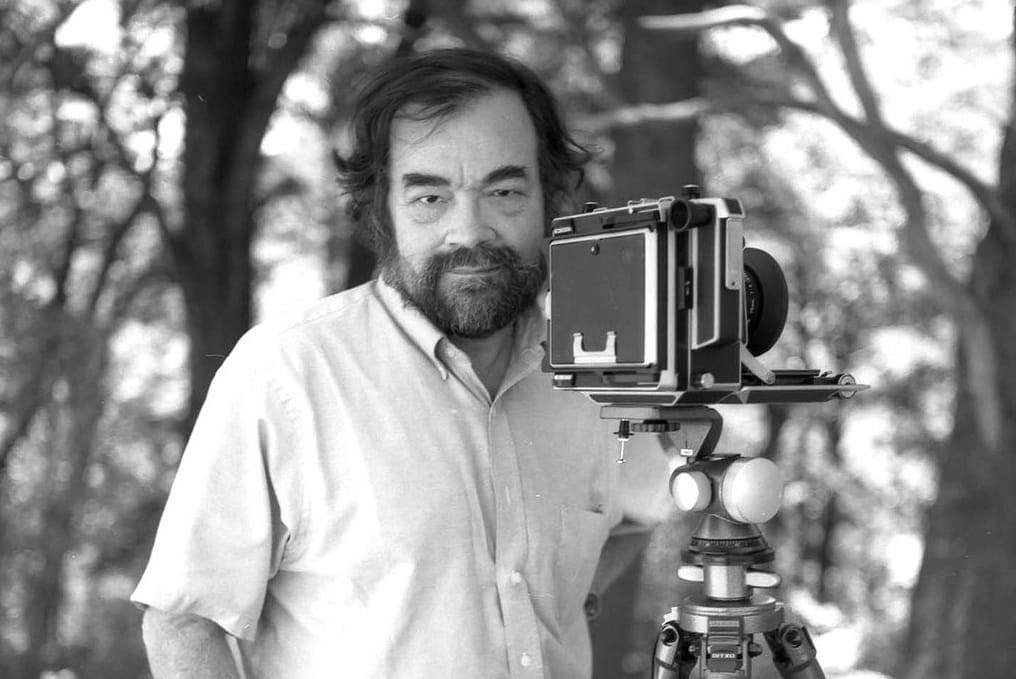

Camilo Salas era periodista antes de decidir usar el arte para transmitir sus propias ideas. Cuando llegó a Nueva York trabajó moviéndose mucho en bicicleta y ocupó esos trayectos para sacarle fotos a la gente de la calle. Al hacerlo, notó indiferencia de su parte. Su conclusión fue que no les molestaba porque estaban acostumbrados a estar rodeados de cámaras.

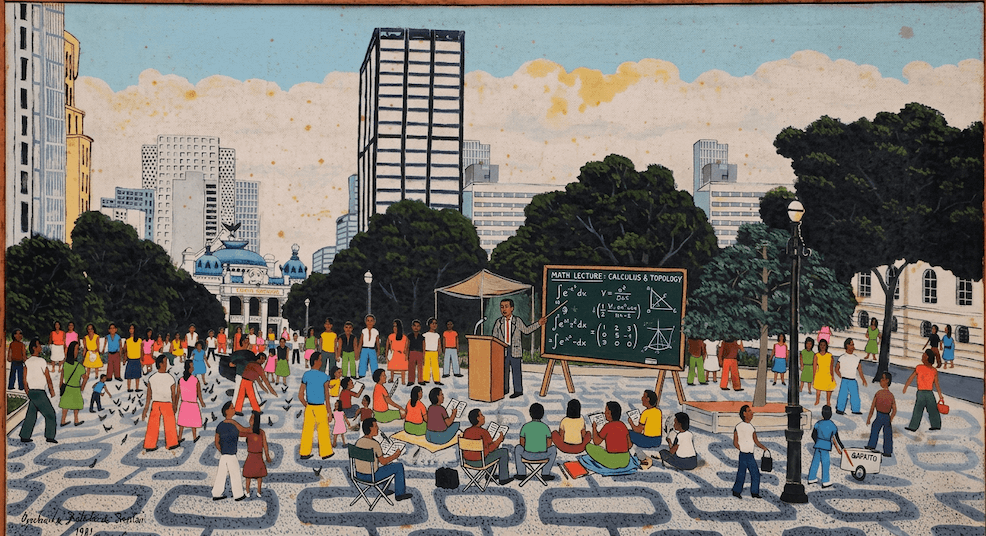

La normalización de la vigilancia en Estados Unidos ha llegado a puntos en que se utiliza en bancos, supermercados y tiendas pero ya no solo para observar a los clientes, sino para entender lo que están haciendo y predecir su comportamiento.

Naturalmente, la tecnología conserva los sesgos de quienes la operan, y en este caso ha servido para apuntar más directamente a minorías, extranjeros y mujeres. Recopilan su información biométrica e incluso los señalan como potenciales ladrones o criminales sin que ellos hayan hecho nada.

Salas explora esta distopía de lo cotidiano, en la que gobiernos y empresas estudian nuestros rostros y formas de caminar para perseguirnos o vender nuestros datos. Ya no es un mero capítulo de Black Mirror, sino un asunto que avanza más rápido que los legisladores que pelean entre ellos para entenderlo.

Entrevista con Camilo Salas, director de Computer Vision

Fintualist: Con el avance de la tecnología nos solemos poner en escenarios catastróficos, pero la verdad es que la distopía parece haber llegado. ¿Cómo ves que esto pueda empeorar? ¿Te aventuras con un pronóstico a futuro? ¿Y qué emociones te provoca esto personalmente?*

Camilo Salas: Esta semana Trump aumentó esfuerzos para echar refugiados políticos o inmigrantes ilegales, usando a agencias de vigilancia como ICE, al FBI y policías locales, que tienen tecnologías de reconocimiento facial y geotracking –para rastrear a la gente vía sus celulares–. El pronóstico catastrófico ya está aquí. Lo único que nos queda es presionar y hacer campaña para que nuestros datos personales y biometría se mantengan privados.

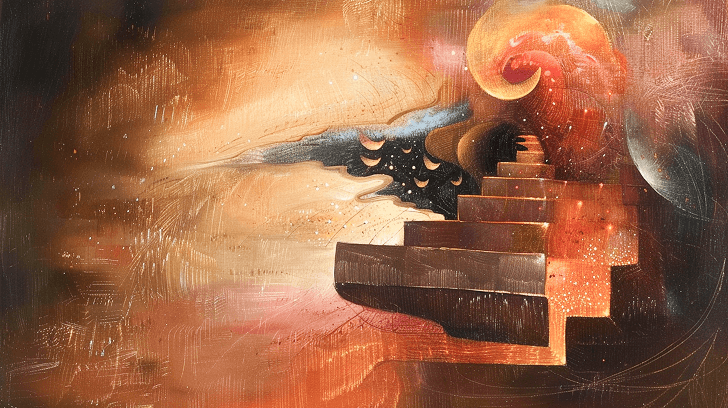

Yo estoy preocupado, al igual que mis compañeros inmigrantes. Creo que el arte es uno de los pocos espacios para crear debate y demostrar cómo este presente tecnológico puede manejarnos.

F: La gente no pareciera estar informada de la magnitud del alcance de la vigilancia. Es algo que incluso a los reguladores les cuesta entender. ¿Cómo crees que debe abordarse? ¿Quiénes deben actuar o tomar responsabilidad? ¿Cómo podría la gente involucrarse?

La sociedad civil, los artistas, creadores y el público general tienen que crear conciencia. Durante las redadas que ha hecho ICE los mismos agentes se tapan la cara, lo que significa que ellos entienden el nivel de conocimientos que se puede llegar a tener. Tienen miedo de que los manifestantes también descubran quiénes son ellos.

El arte tiene el deber de mostrar esto. Creo que hay que abordarlo con políticas públicas y leyes. Como personas lamentablemente no podemos luchar contra ello (a menos que vayamos con mascarilla por la calle), pero no podemos dejar que gobiernos autoritarios pasen a llevar nuestras libertades en su afán de poder completo.

F: En tu película hablas mucho con la IA, incluso pareciera que quieres probar sus límites. ¿Cuál es tu relación con ChatGPT? ¿Y cómo ves el que se haya normalizado tanto su uso por parte de la población en general?

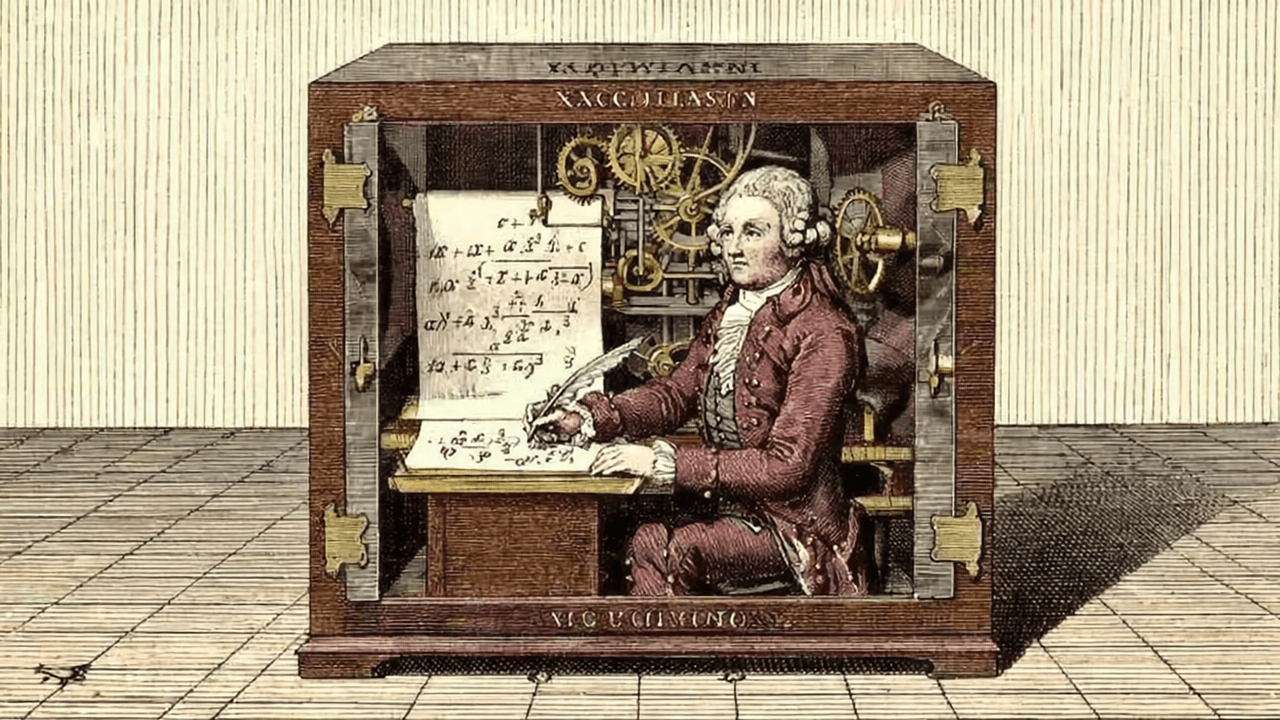

Hablo con ChatGPT y el sistema de IA de Meta. Al principio de la película le pregunto por prejuicios basados en imágenes. Le pregunto quién soy yo y me responde porque yo mismo le he dado esa información.

Internet pasó de ser una utopía, un espacio de creación y conocimiento, a una pesadilla. Un espacio de publicidad, de venta y de ideas de odio. Con ChatGPT aún no sabemos lo que va a pasar. Pero yo no estoy en contra de las cámaras de vigilancia o la tecnología. Ese no es el problema. El problema es quién es el dueño. Y algo muy parecido es ChatGPT, no sabemos qué pasa por detrás.

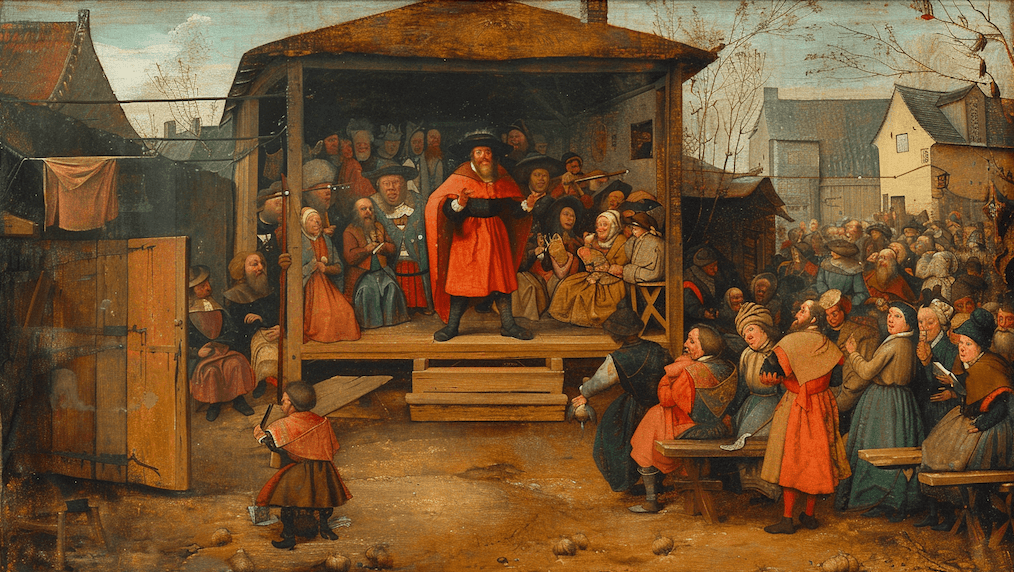

F: Chile no ha llegado a los extremos de Estados Unidos en esta materia. ¿Crees que es cuestión de tiempo? ¿Cómo sientes que va a ser la recepción de la película aquí?

Chile no ha llegado a este nivel, pero al ver las noticias veo que todo es sobre delincuencia, robos y asaltos. Hay mucha inmigración y xenofobia, la gente tiende a buscar culpables. Y después de tantas noticias sobre inseguridad, vienen los comerciales que son todos sobre cámaras y sistemas de seguridad.

Eso me hace pensar que las noticias son un método para meter miedo a la gente y la publicidad sirve para sacarles dinero. Yo no creo que Chile esté mal y poner cámaras tampoco es la solución. En Nueva York, por ejemplo, el metro nunca había sido más seguro pero la gente le tiene más miedo que nunca. Y llenaron de cámaras el metro y sospecho que en Chile va a pasar lo mismo. Veo a candidatos prometiéndolo. Pero no hay ningún país en el mundo que con el uso de cámaras haya bajado la delincuencia.

Espero que la recepción del documental sea interesante y que se cree un debate.

Computer Vision se estrena a las 18:00 en la sala de cine La Secreta (Portales 2685, 2do piso) el lunes 9 de junio.

*Las respuestas fueron editadas para mayor claridad.