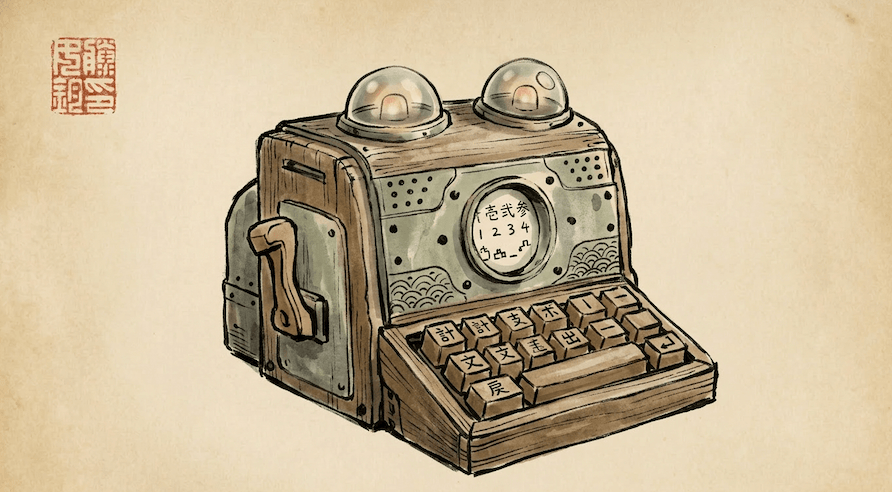

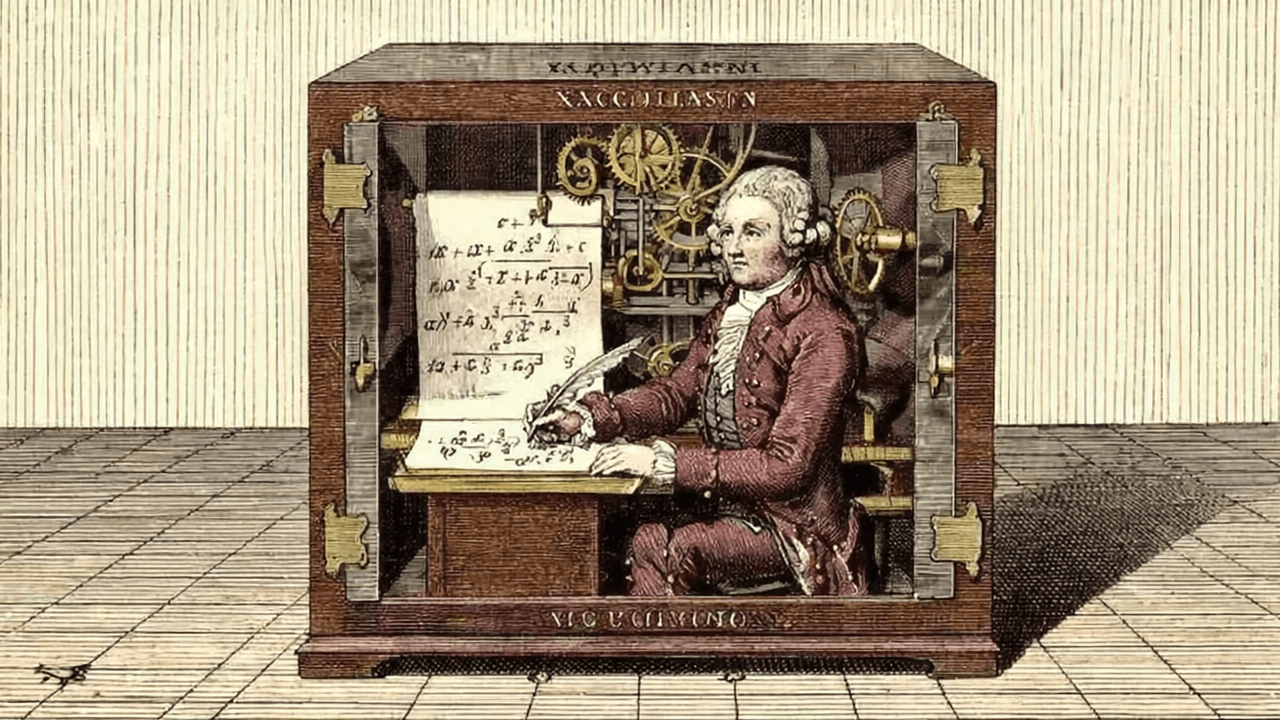

Vamos a hablar de políticas públicas relacionadas con la IA.

Específicamente de las ideas que compartió OpenAI al mundo, que tienen como propósito mantener a las personas en el centro, en esta era de la “inteligencia” (si prefieres, puedes ver nuestra columna semanal en El Fin del Dinero, en T13 radio).

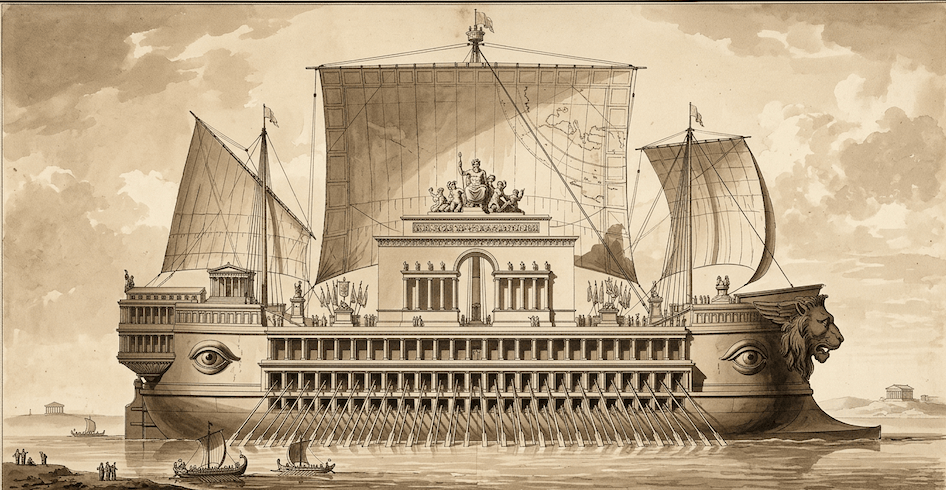

Y específicamente de la superinteligencia artificial, que es uno de los conceptos que más se repite en el documento de 13 páginas que publicaron: la empresa cree que ya estamos en camino de alcanzar la superinteligencia (o sea que se supere la capacidad intelectual de los seres humanos en todos sus aspectos, incluida la creatividad, por ejemplo).

Y esa transición puede ser tan disruptiva, que recomiendan ciertas políticas públicas para atravesarla sin que se genere un caos. Alguna de las medidas que propone:

- Un fondo público: gestionado a nivel nacional (una especie de fondo de reserva de pensiones o de estabilización económica y social, de Chile, que gestiona el Banco Central), con el que las personas participen directamente en el crecimiento económico impulsado por la IA. O sea, que invierta en las empresas de IA

- Derecho a la IA: plantean que el acceso a la IA debe ser tan fundamental como la alfabetización, la electricidad y el internet, y que se debería garantizar el acceso para todos.

- Acelerar la expansión de la red eléctrica: Establecer nuevos modelos de asociaciones público-privadas para financiar y acelerar la expansión de la infraestructura energética necesaria para impulsar la IA.

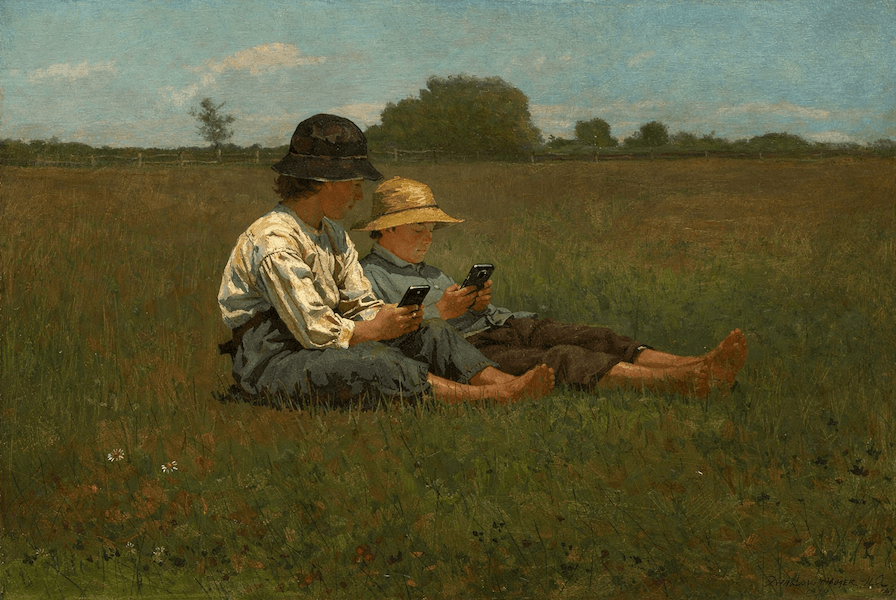

- Y mi favorita: Semana laboral de cuatro días: dice que se podría lograr dado que las eficiencias operativas alcanzadas por el uso de la IA, se traspasarían a los trabajadores entregándoles más tiempo libre.

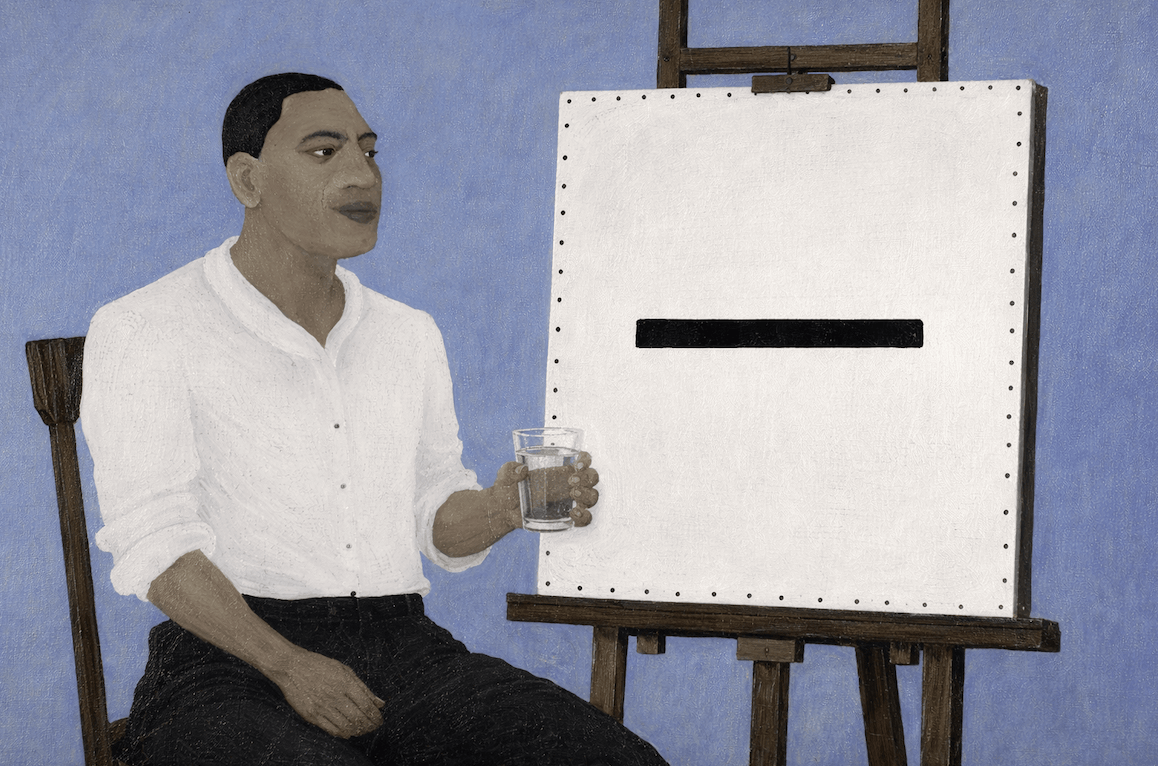

Es mi favorita porque suena algo ingenua. Porque esperar que las empresas naturalmente traspasen los beneficios de la eficiencia operativa a sus trabajadores puede ser medio wishful thinking. Como idea, suena razonable que los beneficios alcanzados se compartan con los trabajadores, pero no parece algo fácil de conseguir. Sobretodo cuando uno ve iniciativas ligadas a IA que no son muy “people first”. Veía hace unos días una startup en Argentina, que su negocio era hacer un diagnóstico de qué % de fuerza laboral podía reemplazarse con IA y te armaba un plan para ejecutarlo y esos trabajadores “pasaban a otro nivel jerárquico” que es como decir que “emprenden nuevos desafíos”.

Y el resto, también parecen medidas razonables, solo que sospechosamente convenientes: un fondo nacional que invierta en empresas de IA, propiciar que todo el mundo tenga acceso a la IA y financiar la expansión de la red eléctrica para contribuir a la capacidad de la IA, son todas medidas que le convienen al negocio de OpenAI. Entonces es medio inevitable recibir estas ideas con algo de suspicacia.

Y sobretodo en el contexto que se da esta publicación, de desavenencias entre Altman y la CFO de OpenAI, Sarah Friar. Porque Altman quiere abrir rápidamente (este año) la empresa a la bolsa y adelantarse a su rival actualmente más cercano Anthropic (recordemos que openAI es una compañía privada, o sea que sus acciones no se cotizan públicamente en una bolsa de valores). Pero la CFO no cree que la empresa estaría lista para salir a bolsa en 2026, por el trabajo organizacional que requiere, pero también por los riesgos derivados de sus compromisos de gasto, ya que ha comprometido un gasto de 600 mil millones de dólares de acá al 2030 y la proyección de ingresos no estaría siendo suficiente para cubrirlos (porque precisamente por la fuerte competencia de Anthropic y otros, el crecimiento de los ingresos se ha ido desacelerando)

La solución de OpenAI para este conflicto? Apartar a la CFO de las discusiones sobre la apertura a bolsa. Eso ha manifestado a sus cercanos la CFO, al menos. Algo así como “por favor llévate tu pesimismo a otro lado”

Y también como contexto, está el perfil que hizo el New Yorker sobre Sam Altman, que tampoco fue muy favorable: básicamente cuestiona que tenga la integridad necesaria o al menos la que se buscaba en los orígenes de la compañía, cuando que se fundó como una entidad sin fines de lucro, bajo la premisa que la IA podía ser el invento más peligroso en la historia de la humanidad.

En ese contexto entonces, parecería que hay permiso para sospechar que este comunicado con ideas para el bienestar de la humanidad tiene algo de conveniencia. Pero ya sea genuino altruismo o conveniencia, que quienes están en la carrera de la superinteligencia nos advierten sobre cambios que serían necesarios en la sociedad, merece la pena una mirada al menos.